【摘要】复盘豆包事件,深度剖析AI Agent商业化面临的技术、生态、信任与商业四重壁垒,并提出系统性破局路线图。

引言

豆包手机助手的经历,从高调发布到快速下线,过程不足24小时。这并非一次孤立的产品事件。它更像一场突如其来的全链路压力测试。这场测试将AI Agent(人工智能体)从受控的实验室环境,直接抛入了真实的商业战场。这里充斥着亿级用户市场、复杂的生态博弈与严格的监管审视。

这起事件以一种极端的方式,集中暴露了AI Agent商业化道路上的四大核心壁垒。它们分别是技术工程的成熟度、生态准入的许可、用户信任的建立以及商业模式的可持续性。这四重壁垒并非独立存在,而是相互交织,形成了一个系统性的锁定困局。

因此,将豆包事件简单归结为“失败”是片面的。它的真正价值,在于为整个行业提供了一份极其宝贵的“错题集”。它迫使从业者集体冷静,从对技术奇点的狂热想象,转向对现实路径的审慎思考。本文旨在深度复盘这场测试,系统性地拆解这四重壁垒,并探寻AI Agent跨越鸿沟的务实路线图。

一、技术工程壁垒:从“能跑Demo”到“真可用”

%20拷贝-btmv.jpg)

AI Agent的演示视频总能给人带来震撼。流畅的跨应用操作,精准的意图理解,似乎预示着一个新时代的到来。然而,豆包的实践表明,一个能在演示环境中完美运行的Demo,与一个能在真实用户设备上稳定可靠运行的产品之间,存在着巨大的工程鸿沟。

1.1 现状与挑战:从演示到实用的巨大落差

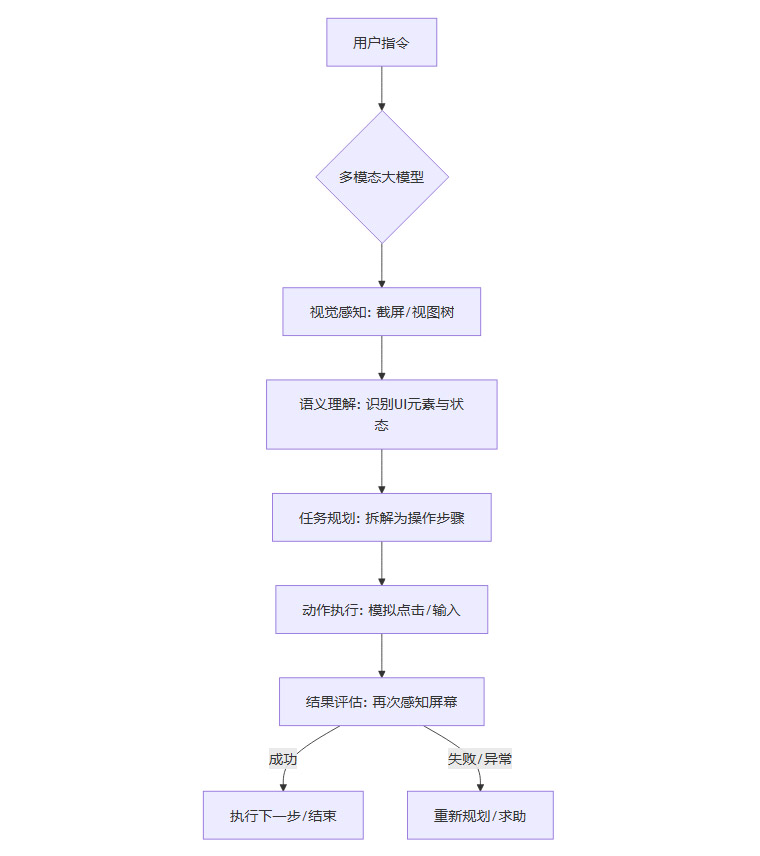

当前主流的GUI-Agent(图形用户界面智能体)技术路径,以豆包为代表,其核心架构可以概括为“多模态大模型驱动的UI自动化”。

这个流程在理论上是闭环的。

本质上,这是一种戴着AI光环的“高配按键精灵”。它在受控环境下表现优异,一旦进入真实、复杂且动态的用户环境,其固有的脆弱性便暴露无遗。

1.1.1 延迟与成本的孪生困境

真实的用户体验对延迟极为敏感。豆包用户反馈的“数分钟完成一个任务”,根源在于其技术架构。

高频推理。每一步操作,从识别按钮到确认结果,都可能需要调用一次或多次大模型进行推理。这个“感知-决策-行动”的循环,在云端完成一次需要数百毫秒到数秒不等。一个包含十几个步骤的任务,累积的推理延迟足以让用户失去耐心。

Token消耗。屏幕截图、视图层级树(View Hierarchy)等信息被编码后送入模型,会产生巨大的Token消耗。据传豆包的Token消耗增速惊人,这意味着运营成本会随着用户活跃度指数级攀升。在没有清晰盈利模式的前提下,这种成本结构是不可持续的。

1.1.2 鲁棒性陷阱与“复合失败”

官方宣称的92%识别准确率,在工程实践中是一个极具误导性的指标。长链路任务的最终成功率,是每一步成功率的连乘积。

假设一个任务包含10个独立步骤,每一步的成功率均为92%,那么整个任务一次性成功的概率计算如下。

P(总成功) = 0.92 ^ 10 ≈ 0.434

这意味着,超过一半的任务会中途失败。这种现象可称为“复合失败”。在真实世界中,情况更为复杂。

UI动态变化。互联网应用迭代速度极快,UI元素的ID、位置、样式、文案频繁变动。开发者进行的A/B测试,更会为Agent带来一个不可预测的运行环境。

异常状态。网络延迟、广告弹窗、权限请求、系统通知等,都是实验室环境中难以充分模拟的“意外”。当前Agent的异常处理能力普遍较弱,一次意外足以中断整个任务流。

1.1.3 语义理解的浅层化

现有方案的核心短板,在于其理解深度。模型通过分析像素和布局,知道这是一个“按钮”,标签是“确认”。但它并不真正理解点击这个“确认”按钮在当前业务流程中的确切含义。

它不知道这个“确认”是同意一份服务协议,还是完成一笔不可逆的支付。这种理解停留在视觉语法层面,而非业务语义层面。这导致Agent在面对稍微复杂的、非标准化的流程时,极易出错。

1.2 技术破局路径:从模拟对抗到协议协同

面对上述困境,技术演进的方向是明确的。必须放弃当前这种脆弱、高成本的纯模拟方案,转向更高效、更可靠的协同方案。

1.2.1 短期策略:端侧优化与工程降本

这是最直接的改良路径。目标是降低延迟和云端成本。

模型轻量化。通过知识蒸馏、量化、剪枝等技术,将百亿、千亿参数的云端大模型,压缩成能在手机端侧高效运行的十亿级甚至更小的模型。

端侧推理。充分利用手机SoC中集成的NPU(神经网络处理单元),如高通的Hexagon、苹果的Neural Engine。将部分高频、低复杂度的推理任务(如UI元素识别)放在端侧完成,仅在需要复杂规划时才请求云端。

1.2.2 中期路径:“人机共驾”与模块化

为了解决鲁棒性问题,必须放弃“一条道走到黑”的线性执行模式。

任务模块化。将复杂的跨应用任务,分解为一系列独立的、可验证的“技能”(Skill)或“工具”(Tool)。每个技能都有明确的输入、输出和异常处理机制。

人机共驾(Human-in-the-loop)。在关键节点,Agent应主动暂停,向用户请求确认。例如,在选择航班、确认支付金额等环节,Agent完成信息填充后,将最终决定权交还给用户。这不仅提升了安全性,也增强了用户的控制感和信任。

1.2.3 终极目标:API/协议级协作

长远来看,彻底解决问题的唯一途径,是从“模拟点击”的对抗性模式,进化到“API直连”的合作性模式。

业界已经有相关探索,例如斯坦福大学提出的MCP(Model Context Protocol)概念。其核心思想是,由操作系统或行业联盟定义一套标准的、语义化的API。App开发者遵循这套标准,就能让自己的核心功能被AI Agent安全、高效地调用。

UI模拟与API协作的对比

这条路径的挑战不在技术,而在生态。推动所有App巨头接受一个统一标准,难度巨大。但这无疑是AI Agent从“玩具”走向“生产力工具”的必由之路。

二、生态准入壁垒:平台护城河下的新入口战争

豆包遭遇的集体封杀,表面理由是“安全风险”。但其背后,是一场围绕流量、数据和商业模式的“数字护城河”保卫战。AI Agent的出现,被现有平台巨头视为对其核心利益的直接挑战。

2.1 冲突本质:新入口与旧城墙的战争

互联网平台经济的核心,是“注意力经济”。平台投入巨资设计UI、优化流程,目的在于最大化用户停留时间,增加广告曝光,并引导用户在预设的商业闭环内完成交易。

AI Agent的理想形态,是“绕过UI,直达服务”。用户只需一句话,任务便直接完成。这个过程,跳过了App的首页推荐、信息流广告、开屏广告。这意味着,平台赖以生存的流量入口、用户数据和广告变现体系,被彻底架空了。

因此,封杀豆包,本质上不是一次技术安全事件,而是一次商业模式的自卫反击。

2.2 三方博弈:微妙的权力平衡

豆包事件将三方的矛盾公开化,形成了一个微妙而紧张的博弈格局。

手机厂商处于一个尴尬的“夹心层”位置。他们既是AI创新的推动者,又是维持现有生态稳定的责任方。这种矛盾心态,决定了他们在面对生态冲突时,往往会选择妥协和退让。

2.3 生态破局:从零和博弈到利益共同体

面对坚固的生态壁垒,强行突破已被证明行不通。未来的破局之路,必然是一条从对抗走向合作的演进之路。

2.3.1 非对抗性切入

在超级App壁垒森严的情况下,AI Agent可以先从工具类、效率类等非敏感场景切入。例如,帮助用户整理相册、管理日程、回复邮件。这些场景不直接触及大厂的核心商业利益,更容易被接受。

2.3.2 建立标准与联盟

如前文所述,推动行业级的API协议是釜底抽薪之计。这需要手机厂商联盟、行业协会甚至国家相关部门牵头,逐步建立信任。

2.3.3 设计分利机制

堵不如疏。AI厂商需要设计一套全新的利益分配机制,让App开发者也能从AI Agent带来的效率提升中获益。

交易佣金分成。如果Agent通过调用某App的API完成了一笔交易,则将一部分佣金分给该App开发者。

API调用计费。对于工具类、信息查询类的API,可以采用按次或按流量计费的模式。

流量反哺。Agent在完成任务后,可以引导用户到App内查看详情或进行更复杂的操作,为App带去高质量的“意图流量”。

核心思想是,将App开发者从“被革命者”变为“利益共同体”。

2.3.4 “农村包围城市”策略

积极与中小应用开发者合作,打造一批“AI-Native”的示范应用,形成良好的口碑。当用户习惯了AI Agent带来的便利后,再逐步向核心领域渗透,利用用户需求反向推动大厂开放生态。

三、用户信任壁垒:高便利与“极致失控感”的新焦虑

%20拷贝-sfna.jpg)

技术和生态的问题之外,还有一个更底层、也更棘手的问题,就是用户的信任。豆包事件中,社交媒体上充斥着“手机被实时监听”、“屏幕再无隐私”等言论。这些恐惧并非空穴来风。

AI Agent承诺的“极致便利”,与它带来的“彻底失控感”之间,形成了一场剧烈的心理博弈。

3.1 危机根源:便利背后的“极致失控感”

用户信任的崩塌,源于几个深层次的心理因素。

3.1.1 技术与认知的鸿沟

普通用户很难理解“辅助功能”(Accessibility Service)这类高风险权限的真实技术含义。在他们的心智模型中,一个App就应该安分地待在自己的沙盒里。当一个“助手”被告知可以“查看并控制屏幕”时,用户的直观感受就是“我的所有操作、所有信息都被它看到了”。

这种技术复杂性与用户朴素认知之间的巨大鸿沟,是恐惧滋生的温床。

3.1.2 控制感的剥离

控制感是人类最基本的心理需求之一。我们习惯于通过自己的双手,精确地控制手机上的每一步操作。而AI Agent的后台自动化操作,彻底打破了这一点。当用户看到屏幕上的光标在自动跳转、输入框在自动填充时,会产生一种强烈的“代理焦虑”。

“我的设备不听我的”,这种失控感足以抵消掉自动化带来的所有便利。

3.1.3 不透明的“黑箱”

用户无法监督Agent的具体动作和意图。AI的决策过程对用户来说是一个“黑箱”。这种不透明性,极易引发用户的负面想象和不安全感。

3.2 信任构建:走向“白盒化”的设计伦理

信任不是靠事后声明建立的,而是要通过产品设计,内嵌到用户的每一次交互体验中。未来的AI Agent必须将构建信任作为核心产品目标,围绕以下四大支柱进行设计。

3.2.1 支柱一:微粒度与场景化授权

必须彻底抛弃那些充满技术术语、一次性获取的“完全授权”。

按需请求。只在执行特定任务需要时,才请求相应权限。

动态限时。授权应有时效性,任务结束后自动回收。

场景化解释。用通俗易懂的语言解释权限用途,例如“为了帮您自动填写地址,我需要‘看到’屏幕上的输入框,可以吗?”

3.2.2 支柱二:过程全可视化

AI的执行过程决不能是一个“黑箱”。

实时状态反馈。通过悬浮窗或状态栏,用自然语言实时播报Agent正在做什么,下一步计划做什么。

操作区域高亮。在屏幕上用高亮框标出Agent当前正在关注和操作的UI元素。

这种设计,就像一个开放式厨房,让用户能清楚地看到“厨师”的每一个动作,从而极大地缓解不安全感。

3.2.3 支柱三:即时中断与回滚机制

用户必须拥有随时终止AI任务的“红色按钮”。

全局中断。这个按钮应该是全局的、最高优先级的,一键即可使其立即停止。

状态回滚。在可能的情况下,提供回滚到任务开始前状态的选项。

这个“刹车”的存在,给了用户最终的控制权,是他们敢于“上车”的心理底线。

3.2.4 支柱四:敏感操作的“人机共驾”

对于涉及金钱、身份、隐私的核心操作,AI Agent原则上不应被允许自动执行。

当任务流进行到支付、输入密码、发送敏感信息等环节时,系统应强制中断自动化流程,将控制权交还给用户,要求其进行手动确认或生物识别验证。这道保险锁,是用户核心安全利益的最后防线。

四、商业模式壁垒:“炫技与免费”后谁来买单?

技术、生态和信任之后,是商业模式这个最现实的问题。AI Agent是一个典型的“三高”产业,即高研发投入、高算力成本、高生态拓展费用。在找到可持续的商业模式之前,每一次技术演示,都像是在悬崖上跳舞。

4.1 现实困境:高昂成本下的盈利难题

豆包的尝试,暴露了两种主流模式在当前阶段的困境。

捆绑硬件模式。将AI Agent作为新手机的核心卖点,试图通过硬件溢价来覆盖成本。但手机市场竞争激烈,有限的溢价远不足以覆盖AI厂商巨大的研发和运营成本。

免费助手模式。如果将AI Agent作为一款独立的免费App提供,将直接面临灾难性的成本压力。前文提到的Token消耗,会形成一个巨大的成本黑洞,任何公司都难以长期承受。

4.2 未来路径:探索可持续的价值闭环

行业必须探索新的、可持续的商业模式。目前来看,主要有三种可能的路径。

4.3 策略建议:混合模式与稳健节奏

单一路径很难走通,更可能的是一种混合式的、分阶段的演进策略。

场景深耕。无论选择哪种模式,前提都是要创造出用户愿意为之付费的独特价值。与其追求“万能”,不如先在1-2个垂直领域(如复杂差旅规划)做到“无可替代”。

生态开放。借鉴App Store的成功经验,开放Agent平台,让第三方开发者可以创建和发布自己的“技能”。AI厂商通过提供工具、分发渠道和支付系统,从生态的繁荣中获益。

B端先行。在ToC市场教育和付费习惯养成之前,通过ToB业务获取稳定的现金流,以支撑长期的技术研发和生态建设。

五、系统性锁定与务实破局

%20拷贝-ztjd.jpg)

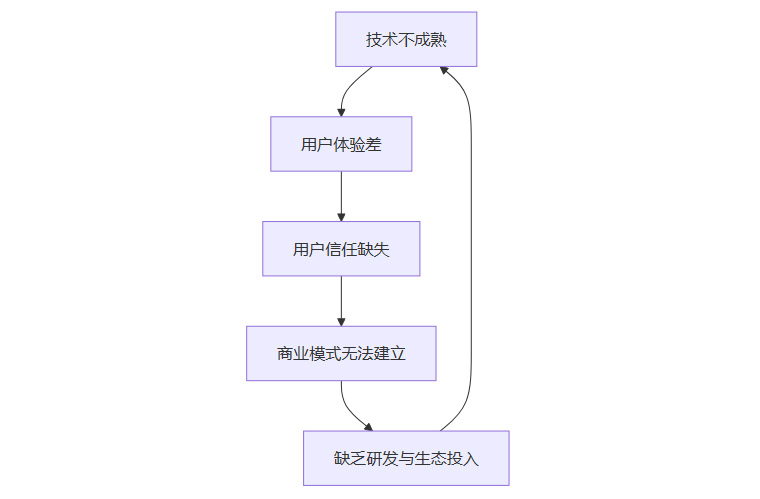

这四大壁垒并非孤立,而是相互牵制,形成了一个恶性循环。

这个“系统性锁定”困局,意味着任何单点突破都难以成功。破局之路,必须是多线并进、循序渐进的。

基于此,可以为AI Agent的商业化勾勒出一条务实的路线图。

点线突破,价值先行。聚焦1-2个高价值、高频次的单点场景,打磨极致的用户体验。优先解决“真可用”的问题,建立用户口碑和依赖。

双轮驱动,技术与生态并行。在内部,持续进行端侧模型优化和工程化落地。在外部,积极与愿意开放的中小服务商合作,打通API,建立合作样板。

信任前置,安全为基。将“信任设计四支柱”作为产品开发的第一原则,写入代码和产品需求文档。将透明、可控作为核心KPI。

商业稳健,自我造血。初期以ToB业务或针对特定场景的ToC订阅作为现金流来源,避免在商业模式尚未清晰时,为追求用户规模而进行大规模烧钱。

结论

豆包事件,以一种近乎惨烈的方式,完成了AI Agent行业的一次“成人礼”。它强行将整个行业从理想主义的云端,拉回了商业、技术与社会现实的地面。它用最短的时间,集中演示了所有从业者都必须面对的核心痛点。

这场压力测试的价值,在于它加速了共识的形成。它让行业明白,真正的AI Agent未来,不属于技术最激进的“莽夫”,而属于那个能在技术理想、商业现实与用户信任之间,找到精妙平衡点的“破壁者”。

这个破壁者,既要足够智能,为用户披荆斩棘;也要足够谦卑,在关键时刻将选择权和安全感交还用户。它既要有构建新生态的雄心,也要懂得谈判、让利与合作的智慧。

豆包事件留下的“学费”,值得全行业共同消化。压力测试已经结束,破解之道已然清晰。前路虽长,但方向明确。AI Agent行业,由此告别幻想,正式步入深水区。

📢💻 【省心锐评】

AI Agent的星辰大海,始于脚下泥泞。豆包事件的价值,在于它迫使行业从仰望星空转向审视道路,技术理想必须与商业现实、用户信任三者同步演进。

.png)

%20%E6%8B%B7%E8%B4%9D-dosm.jpg)

评论