【摘要】AI“幻觉”风险难测,全球保险业正通过除外条款收紧承保边界,企业部署AI面临严峻的责任敞口。

引言

生成式人工智能(Generative AI)正以前所未有的速度渗透到企业运营的各个层面,从代码辅助生成到客户服务自动化,其应用边界不断拓宽。然而,在这场技术浪潮之下,一个潜藏的巨大风险正在浮出水面,那就是AI的“幻觉”(Hallucination)问题。当一个被企业委以重任的AI系统开始“一本正经地胡说八道”,其后果已不再是简单的技术尴尬,而是可能引发数亿美元索赔的法律与财务灾难。

面对这一新型且难以量化的风险,长期作为企业技术风险“稳定器”的保险行业,正表现出前所未有的审慎与退缩。全球多家保险巨头不再尝试为这一风险定价,而是选择直接将其从保单中“排除”。这种集体性的“硬性转向”,正在企业与AI技术之间撕开一个巨大的“保险真空”。对于每一位架构师、技术决策者和企业管理者而言,理解这场变革的底层逻辑,并重新构建企业的AI风险管理框架,已是迫在眉睫的议题。

一、🛡️ 保险业的“硬性转向”:从风险定价到风险排除

%20拷贝-xsvq.jpg)

传统保险的核心是风险定价(Risk Pricing)。通过精算模型评估某一事件发生的概率与可能造成的损失,保险公司为风险标定一个价格,即保费。企业通过支付保费,将不确定的巨大损失转化为确定的、可控的成本。然而,面对生成式AI,这套运转了数百年的商业逻辑似乎正在失灵。

1.1 主流巨头的“除外责任”备案潮

近期,全球保险市场释放出一个明确且强烈的信号。包括美国国际集团(AIG)、美国大都会保险(Great American Insurance)和WR Berkley在内的行业巨头,已相继向美国监管机构提交备案文件。其核心诉求高度一致,即在标准的企业责任保险(如网络安全险、错误与疏漏险)中,增加针对AI风险的**“除外责任条款”(Exclusion Clause)**。

这意味着,未来企业因部署和使用AI工具(包括但不限于聊天机器人、自主智能体、内容生成模型等)而导致的第三方索赔或自身损失,将可能被保险公司直接拒赔。

1.2 条款的广度与“一刀切”倾向

部分保险公司提出的条款覆盖范围之广,值得技术管理者高度警惕。以WR Berkley提议的条款为例,其措辞极为严苛,规定任何**“涉及任何实际或声称使用AI”**的索赔均不予承保。

这一定义的解释空间极大,理论上可以涵盖:

直接使用AI工具:企业客服聊天机器人提供了错误的法律或医疗建议。

内嵌AI的产品或服务:企业销售的智能分析软件,其内置的AI算法出现偏差,导致客户做出错误的商业决策。

供应链中的AI风险:企业使用的第三方SaaS服务内嵌了AI功能,该功能出错导致企业数据泄露或业务中断。

这种“一刀切”式的排除,反映出保险业在当前阶段,对于精确划分和评估AI风险缺乏足够的技术手段与信心。与其陷入复杂的理赔纠纷,不如从源头上将这一整个风险类别划出承保边界。AIG虽然表示“目前暂无实施计划”,但其备案行为本身,就是为未来启用该条款保留了法律上的选择权,这是一种行业性的预防性布防。

二、🎲 风险根源:AI“幻觉”与不可解的“黑箱”

保险业的集体退缩,根源在于生成式AI技术本身固有的两大特性,它们共同颠覆了传统风险评估的基石。

2.1 AI“幻觉”的技术溯源与风险形态

从技术角度看,大型语言模型(LLM)的“幻觉”并非程序Bug,而是其核心工作原理的副产品。LLM本质上是一个概率分布模型,它在生成内容时,是基于其庞大的训练数据,预测下一个词、一句话最有可能是什么,而非从知识库中进行事实检索。

这种机制导致了“幻觉”的几种典型风险形态:

事实捏造(Factual Fabrication):生成完全虚构的人物、事件、数据或研究论文。

错误归因(Misattribution):将真实存在的信息错误地安插在不相关的主体上,例如谷歌AI概览错误声称某公司被起诉。

逻辑谬误(Logical Fallacies):在推理和论证过程中出现不合逻辑的跳跃或矛盾。

过时信息(Outdated Information):基于旧的训练数据,提供已失效的法律条款、产品价格或技术规范。

这些“幻觉”产物一旦被企业应用在严肃的商业场景中,就直接转化为法律和财务上的“硬风险”。

2.2 “黑箱”特性对精算模型的颠覆

保险精算学的基石是**“大数法则”与“历史数据”**。保险公司通过分析海量的历史索赔数据,来预测未来的风险概率和损失分布。然而,AI模型,尤其是LLM,呈现出高度的“黑箱”特性,这让传统精算模型彻底失效。

正是这种不可预测、不可解释、缺乏历史数据的特性,让保险公司认为AI风险是一个无法定价的“盲盒”,承保它无异于赌博。

2.3 责任归属的“多方迷雾”

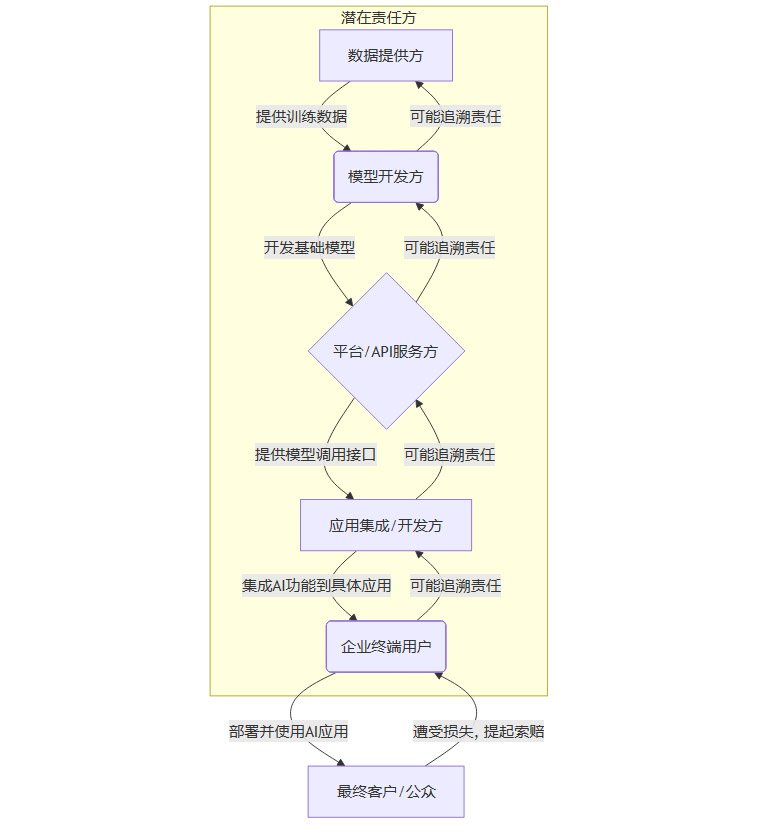

AI事故的责任链条异常复杂,远超传统软件。一旦出现问题,责任可能分布在多个参与方之间,形成一张错综复杂的网络。

我们可以用一个流程图来描绘这个责任链:

当最终客户F因AI应用的错误输出而遭受损失时,责任究竟在谁?

是企业终端用户E?因为其未能尽到充分的监督和审核义务。

是应用集成方D?因为其在应用设计中未能设置足够的“护栏”。

是平台服务方C(如OpenAI, Google)?因为其提供的模型API存在缺陷。

是模型开发方B?因为其在模型训练和对齐阶段存在疏忽。

还是数据提供方A?因为训练数据本身就包含偏见或错误信息。

目前,无论是法律体系还是行业合同范本,都未能对这个“多方迷雾”给出清晰的划分方案。这种法律上的不确定性,是保险公司选择规避的另一个核心原因。

三、📈 从理论到现实:正在上演的高额索赔剧本

%20拷贝-qqhb.jpg)

AI风险不再是纸上谈兵的理论推演,一系列真实发生的高额索赔案件,正在将这种风险具象化为真金白银的损失。这些案例集中体现了AI错误已从过去的“技术圈笑料”升级为企业必须正视的实质性法律与财务风险。

3.1 真实案例深度剖析

下表梳理了近期几起标志性的AI相关事故,并分析了其背后的风险类型与启示。

3.2 风险类型的演变与升级

这些案例揭示了一个重要趋势:AI引发的风险正在超越传统网络安全的范畴。

传统网络风险:主要集中在数据泄露、系统中断、勒索软件等,核心是系统安全与数据隐私问题。

新型AI风险:则更多地表现为信息内容与决策行为的风险,如诽谤、欺诈、侵权、合同纠纷、歧视性决策等。

这种转变意味着,企业的风险管理体系需要从IT部门扩展到法务、合规、运营乃至公关部门。仅仅依靠防火墙和加密技术,已无法抵御由AI“幻觉”和深度伪造带来的新型攻击。

四、🌪️ 系统性风险:压垮保险业的“最后一根稻草”

如果说单个企业因AI失误造成几亿美元的损失还在保险公司的承受范围内,那么真正让整个行业感到恐惧的,是AI可能带来的系统性、聚合性风险(Systemic and Aggregated Risk)。

4.1 单点风险 vs. 聚合风险

理解这两者的区别至关重要。

单点风险(Single-Point Risk):指单一企业在特定场景下使用AI出错。例如,一家医院的AI辅助诊断系统出现误诊。这种风险是孤立的,影响范围有限。安联(Aon)网络风险负责人Kevin Kalinich指出,行业尚可承受这类4亿至5亿美元级别的损失。

聚合风险(Aggregated Risk):指由一个共同的风险源头,引发的大规模、高度相关的连锁损失。在AI时代,这个共同的风险源头就是主流的基础模型或平台服务。

4.2 AI时代的风险传导机制

设想一个场景:某个被全球数万个应用共同调用的主流大语言模型(例如GPT-4或Claude 3),因一次模型更新或数据污染,出现了一个隐蔽的系统性偏见或漏洞。

这个漏洞可能导致:

所有使用该模型API的金融分析工具,都开始推荐一只错误的股票。

所有基于该模型构建的法律咨询聊天机器人,都开始引用一条已失效的法条。

所有使用该模型进行内容审核的平台,都开始错误地封禁正常账号。

在这种情况下,索赔将不再是零星发生,而是在短时间内集中爆发。成千上万家企业会因为同一个底层原因而遭受损失,并向各自的保险公司提出索赔。这种“多米诺骨牌”式的风险传导,其规模将是保险业从未遇到过的。它无法通过地域、行业或客户的分散来对冲,可能在瞬间击穿整个市场的承保能力。

这正是保险公司急于划清界限的根本原因。它们承保的是可预测、可分散的风险,而不是可能导致整个行业崩溃的系统性灾难。

五、📄 保单解构:现有保障体系的裂痕与压缩

%20拷贝-twag.jpg)

随着AI除外条款的逐步引入,企业现有的保险保障体系正在被悄然重塑。技术管理者需要仔细审视自己公司的保单,理解哪些风险正在被移出保障范围。

5.1 不同险种的保障范围变化

5.2 “批单”的陷阱:名为澄清,实为限缩

为了应对市场需求与监管压力,一些保险公司并未完全“一刀切”,而是通过**“批单”(Endorsements)**,即保单附加条款,来处理AI风险。这些批单看似提供了某种程度的保障,但实际上往往伴随着极其严格的限制。

一个典型案例是保险公司QBE推出的批单。该批单声称可以为企业因违反欧盟《人工智能法案》而面临的罚款提供有限保障。然而,细读条款会发现:

极低的赔付上限:据大型经纪商透露,该批单将AI相关罚款的赔付上限,严格限制在保单总限额的2.5%。一张1000万美元的保单,最多只能赔付25万美元,对于可能高达数千万欧元的罚款而言,无异于杯水车薪。

严格的触发条件:通常要求企业必须证明已采取了所有“合理”的合规措施,这在实践中极难举证。

这种做法的本质,是在名义上“填补缺口”,实际上通过**“高门槛、低赔付”**的方式,将绝大部分风险仍然留给了企业自身。企业在看到保单中含有“AI保障”字样时,必须与法务和专业经纪人一同,逐字逐句地审查其限制条件。

5.3 差异化探索:从“全面拒保”到“精准承保”

并非所有保险公司都选择完全退场。市场上也出现了一些差异化的探索,其核心思路是放弃为不可控的广泛风险兜底,转而为特定、狭义、可界定的AI风险提供“精准定制”的保险产品。

场景细分:例如,**安达保险(Chubb)**在与客户谈判时,同意承保部分AI风险,但明确排除了影响大量客户的“广泛性”或“系统性”模型故障。这意味着,单个聊天机器人失控的个案可能在承保范围内,但基础模型升级导致所有聊天机器人都出错的情况则被排除。

风险类型细分:在中国市场,中国人保财险等公司已开始试点推出**“生成式AI内容侵权责任险”**。这类产品不再笼统地承保所有AI风险,而是聚焦于版权、商标、名誉权等具体的侵权场景,并对赔偿边界和适用条件做出严格限定。

这一趋势表明,未来的AI保险市场可能不再是“一张保单保所有”,而是会演变成一个由多个“窄而深”的专项产品构成的碎片化市场。

六、🏛️ 企业的应对之道:重构AI时代的风险管理框架

面对保险业的集体后撤,企业不能再将保险视为AI风险管理的“万能解药”或“最后一道防线”。将风险简单外包给保险公司的时代已经过去。现在,企业必须构建一套以内控为主、保险为辅的全新AI风险管理框架。这不仅是技术问题,更是涉及法务、合-规、运营和战略的系统工程。

6.1 法律与合同层面的“防火墙”

在引入任何AI技术或服务之前,法务和采购部门必须前置介入,通过严谨的合同条款来划分责任边界。

6.1.1 供应商合同审查要点

与AI技术供应商(无论是模型提供商、平台服务商还是SaaS厂商)签订合同时,应重点关注并谈判以下条款:

数据责任条款:明确训练数据的来源、质量和合规性责任。如果因供应商提供的训练数据包含偏见或侵权内容,导致企业AI应用产生不良后果,责任应由谁承担?

模型性能保证(SLA):虽然供应商通常会拒绝为模型的“幻觉”率或准确性提供硬性SLA,但可以争取将某些关键性能指标(如偏见指数、特定场景下的错误率上限)写入合同,并约定相应的补救措施或赔偿机制。

赔偿责任上限(Limitation of Liability):供应商通常会试图将其赔偿责任上限限制在合同金额的1-2倍。企业应力争提高这一上限,尤其是在AI应用涉及高风险领域(如金融、医疗)时,确保其与潜在损失相匹配。

知情与更新义务:要求供应商在对模型进行重大更新或发现严重漏洞时,有义务及时通知企业,并提供相应的风险评估报告和应对建议。

6.1.2 内部责任划分

企业内部也需要建立清晰的AI责任框架。例如,可以借鉴RACI模型(Responsible, Accountable, Consulted, Informed),明确AI项目在生命周期中各个角色的职责。

通过这样的矩阵,可以确保在AI应用的每个环节,都有明确的责任人,避免在出现问题时相互推诿。

6.2 技术与运营层面的“安全护栏”

除了法律合同,更重要的是在技术和运营层面建立起强大的“安全护栏”(Guardrails),从源头上减少AI犯错的概率和影响。

6.2.1 “人在回路”(Human-in-the-Loop)机制

在任何高风险或面向客户的场景中,完全依赖AI进行自主决策是极其危险的。必须设计**“人在回路”或“人机协同”**的工作流。

人工审核(Human Review):对于生成合同、法律文书、医疗建议等关键内容,AI的输出必须经过具备专业资质的人员审核后才能发布。

人工覆盖(Human Override):在自动化流程中,应设置明确的触发条件(如AI输出的置信度低于阈值、检测到敏感词汇、客户情绪升级等),一旦触发,系统应自动将任务转交人工处理。

分级授权:根据AI任务的风险等级,设定不同的自动化程度。低风险任务(如内部文档摘要)可以高度自动化,而高风险任务(如金融交易指令)则必须由人工最终确认。

6.2.2 输入与输出的严格控制

控制模型的输入(Prompt)和过滤模型的输出,是降低“幻觉”风险的有效技术手段。

提示工程(Prompt Engineering):设计结构化、明确、带有约束条件的提示词,引导模型在安全的框架内生成内容。例如,通过“角色扮演”提示(“你是一位严谨的法律助理,请仅基于以下提供的《合同法》原文回答问题”)来限制模型的自由发挥。

检索增强生成(RAG):不让模型完全依赖其内部知识,而是结合一个可信的、实时更新的外部知识库。模型在回答问题时,首先从知识库中检索相关信息,再基于这些信息进行回答,可以大幅提高事实准确性。

输出过滤器(Output Filtering):在模型输出后,部署一层或多层过滤器,用于检测不当内容、事实错误、敏感信息泄露等。一旦发现问题,可以进行拦截、修改或警告。

6.3 治理与文化层面的“免疫系统”

最终,AI风险管理需要内化为企业的组织文化和治理体系,形成一种“免疫系统”。

建立AI治理委员会:成立一个跨部门的AI治理委员会,由技术、法务、合规、业务、道德伦理等领域的专家组成,负责制定全公司的AI使用原则、评估高风险项目、并定期审计AI应用的表现。

开展持续的员工培训:让所有接触AI工具的员工都理解其局限性,尤其是“幻觉”问题。培养员工的批判性思维,不盲信AI的任何输出,并知道在发现问题时应如何上报。

拥抱透明度与可解释性:在可能的情况下,优先选择那些提供一定可解释性(Explainable AI, XAI)的工具。即使无法完全解释,也应向用户和客户明确告知,相关服务由AI驱动,其结果可能存在错误,并提供反馈和申诉渠道。

七、🔮 未来展望:在“大事件”前后重塑规则

%20拷贝-eywl.jpg)

当前保险业对AI风险的规避,本质上是一种在重大系统性事件发生前的预防性防御。整个行业都在屏息等待,或者说恐惧,那一次可能动摇整个数字经济根基的“大事件”的到来。

7.1 “大事件”前的加速收紧

在可预见的未来1-3年内,保险条款的收紧趋势只会加速,不会逆转。企业将面临一个越来越大的保障缺口。在此期间,监管机构(如美国的保险监督官协会NAIC、欧盟的EIOPA)的角色将至关重要。他们可能会介入,要求保险公司提供更清晰的条款解释,甚至推动开发某些基础性的、标准化的AI风险保障产品,以避免市场失灵。

7.2 “大事件”后的行业重塑

律师和经纪人普遍预期,真正能够迫使保险业、科技行业和法律界坐下来,共同重塑AI风险分担规则的,将是某次标志性的、大规模的系统性AI事故。

这次“大事件”可能会像当年的“911事件”重塑恐怖主义保险市场,或像“NotPetya”攻击重塑网络战争除外条款一样,成为AI责任保险领域的分水岭。

事件发生后,可能会出现以下变化:

法律判例的出现:法院将首次就AI事故的“多方迷雾”做出标志性判决,为责任划分提供判例依据。

强制性保险要求:监管机构可能要求高风险AI服务的提供商,必须购买特定类型的强制性责任保险,类似于机动车的交强险。

新型保险产品的成熟:在有了更清晰的法律框架和更多的损失数据后,保险公司将更有能力开发出针对性的、定价合理的AI保险产品。

对于身处其中的技术从业者和企业而言,我们正航行在一片未知的水域。与其被动等待风暴的到来,不如现在就开始加固自己的船体,构建强大的内部风险管理能力。因为在AI时代,最可靠的保险,终究是企业自身的审慎、远见与责任感。

结论

生成式AI的“幻觉”问题,已从一个技术层面的挑战,演变为引爆企业责任风险、并深刻重塑全球保险业格局的催化剂。保险公司通过增设“除外责任”条款,正在系统性地将难以量化的AI风险剥离出其承保范围,这使得在AI浪潮中加速前行的企业,正面临一个前所未有的“保险真空”。

面对这一结构性变化,企业无法再依赖传统的风险转移策略。唯一的出路是向内求索,建立一套从法律合同、技术架构到组织治理的多层次、立体化AI风险内控体系。通过明确责任边界、部署技术“安全护栏”、并培育审慎的AI使用文化,企业才能在享受AI技术红利的同时,有效管理其伴生的巨大风险。未来的竞争,不仅是AI应用深度的竞争,更是AI风险管控能力的竞争。

📢💻 【省心锐评】

保险业的集体“免责”是AI风险从理论到现实的明确信号。企业必须放弃“保险兜底”的幻想,将AI治理提升至战略高度,否则,下一个因“幻觉”而付出惨痛代价的,可能就是自己。

.png)

评论