【摘要】OpenAI推出ChatGPT群聊功能,基于GPT-5.1模型,通过创新的速率限制与智能介入机制,重塑人机协作范式,旨在将AI无缝融入团队工作流。

引言

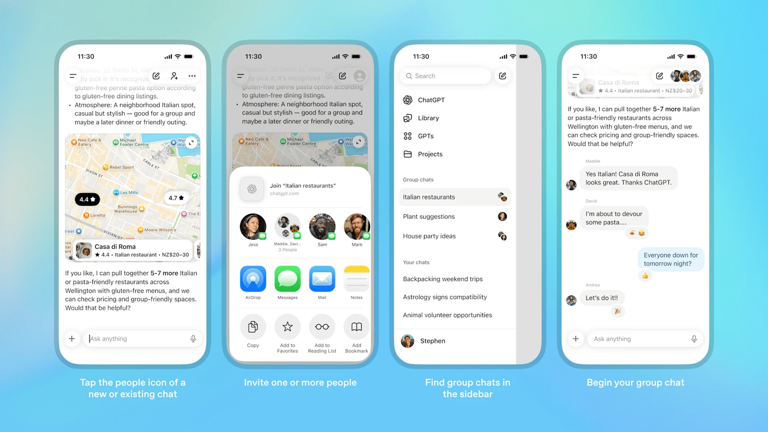

人工智能领域的发展,长期以来聚焦于提升模型在“一对一”交互中的能力。从简单的问答系统到复杂的个人助理,其核心交互范式始终围绕着单个用户与AI的对话。然而,人类的知识生产与创新活动,本质上是群体性的、协作性的。2023年11月14日,OpenAI在韩国、新西兰等市场投下了一颗重磅炸弹,正式试点ChatGPT的群聊功能。

这并非一次简单的功能迭代。它标志着AI助手的设计哲学正在发生根本性转变,从一个听候指令的**“工具”,向一个能够融入复杂多人环境、具备上下文感知能力的“团队成员”**演进。此举背后,是GPT-5.1模型的算力支撑,更是对多用户上下文管理、交互成本控制、智能介入时机等一系列核心技术难题的系统性解答。本文将从技术架构、交互机制、应用场景及未来演进四个维度,深度剖析ChatGPT群聊功能的设计思想与技术实现,探讨其如何重塑人机协同的未来。

💡 一、群聊功能的核心架构与技术底座

%20拷贝.jpg)

ChatGPT群聊功能的实现,并非简单地将一个单用户模型接入多人对话管道。它依赖于一个为多智能体、多线程对话场景深度优化的技术栈。其核心由三部分构成,分别是作为能力基础的GPT-5.1模型、处理复杂对话流的多用户上下文管理器,以及决定AI行为模式的智能介入决策引擎。

1.1 GPT-5.1模型:为协同而生的能力跃迁

群聊功能的技术基石是最新发布的GPT-5.1模型。尽管OpenAI未公布其详细的技术参数,但从其在群聊场景中的表现,我们可以推断其在几个关键维度上实现了显著增强。

1.1.1 长程与多线程上下文理解

传统的语言模型在处理长对话时,常因上下文窗口(Context Window)的限制而出现信息遗忘。在群聊中,这个问题被指数级放大。对话不再是线性的,而是多线程、交叉进行的。GPT-5.1必须具备强大的长程上下文理解能力,才能在数十甚至上百条消息后,依然能准确回忆起对话早期的关键信息。

同时,它还需要具备**对话线程分离(Thread Disentanglement)**的能力。这意味着模型能够识别出群聊中并存的多个子话题,并将用户的提问或指令精确关联到对应的上下文中。这可能得益于更高效的注意力机制,例如分段注意力(Segmented Attention)或记忆增强网络(Memory-Augmented Networks),使其能够在庞杂的对话历史中,动态聚焦于最相关的部分。

1.1.2 角色与意图的精准识别

在多人环境中,模型不仅要理解“说了什么”,更要理解“谁在说”以及“对谁说”。GPT-5.1展现了对**说话者角色(Speaker Role)和对话意图(Dialogue Act)**的精准识别能力。

说话者归属(Speaker Diarization):模型能够将每一条消息与特定的用户身份绑定,形成

[用户A: 消息1],[用户B: 消息2]这样的内部表征。意图分类:模型能判断出一条消息是陈述、提问、指令、附和还是反驳。这种深层语义理解是其决定是否介入、如何介入的基础。例如,对于一个明确指向ChatGPT的指令,其响应优先级远高于用户间的闲聊附和。

1.1.3 低延迟与高并发处理

群聊场景对模型的响应速度提出了严苛要求。如果AI的回应延迟过高,就会打断自然的对话流。GPT-5.1可能采用了**模型蒸馏(Model Distillation)和量化(Quantization)**等优化手段,在保证模型能力的同时,大幅降低推理延迟。同时,其后端架构必须支持高并发请求,以服务于全球范围内成千上万个并行的群聊会话。

1.2 多用户上下文管理器(Multi-User Context Manager)

上下文管理器是连接底层大模型与上层应用的“中枢神经系统”。在群聊功能中,它的设计远比单用户场景复杂。其核心任务是构建并维护一个结构化的、能够被GPT-5.1高效理解的会话状态。

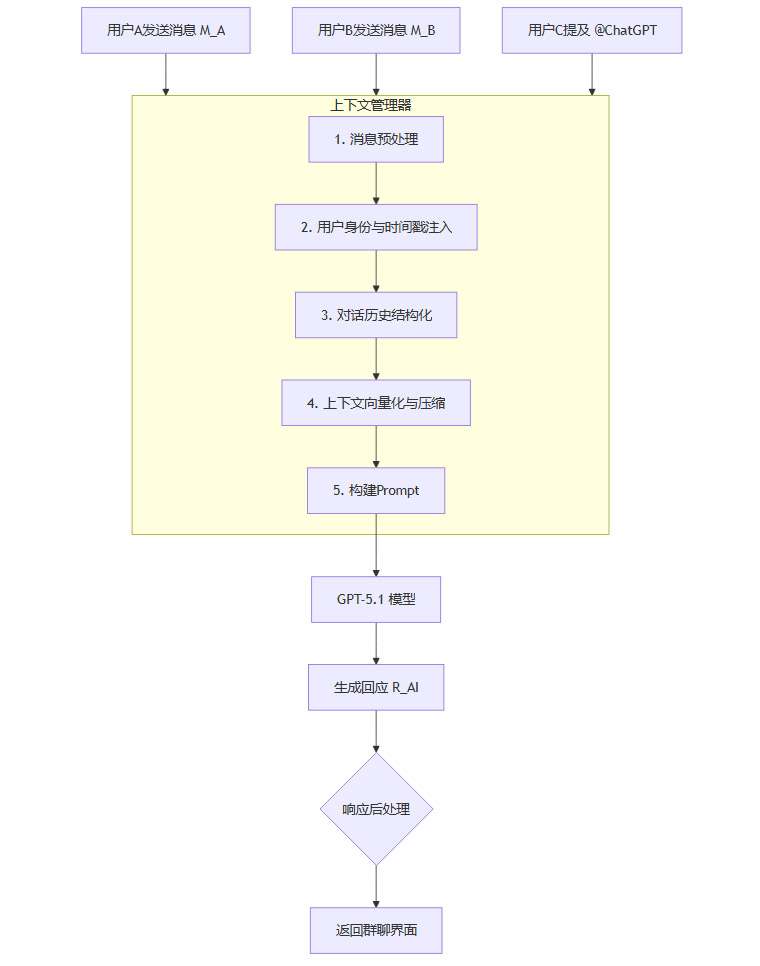

下面是一个简化的群聊上下文管理流程图。

1.2.1 对话历史的结构化表示

管理器不会将原始的聊天记录直接投喂给模型。它会将对话历史转换成一种结构化的格式。这种格式不仅包含消息内容,还附加了丰富的元数据。

通过这种结构化,模型可以清晰地理解对话的时序关系、人物关系和指令关系。

1.2.2 上下文压缩与摘要技术

即便有再大的上下文窗口,无限增长的对话历史最终也会超出限制。因此,上下文管理器必须采用**上下文压缩(Context Compression)**技术。当对话过长时,系统会自动对早期的、非核心的对话内容进行摘要,用一段凝练的文本替代冗长的原始记录。例如,一段关于午餐吃什么的讨论,在几轮对话后可能会被压缩为一句“团队成员讨论并决定了午餐”。这种机制确保了核心上下文得以保留,同时极大地节省了Token消耗。

1.3 智能介入决策引擎(Intelligent Intervention Decision Engine)

ChatGPT在群聊中最大的特点之一,就是其克制而精准的介入时机。这背后是一个复杂的决策引擎在工作,它基于一系列加权因子,实时计算AI介入的必要性与优先级。

该引擎的决策过程可以被建模为一个分类问题,即对每一条新出现的用户消息,判断其属于以下哪一类。

强介入(High Priority):用户消息明确提及“ChatGPT”或使用

@符号,包含直接指令。中等介入(Medium Priority):消息是一个开放性问题,且话题与AI知识领域高度相关,但未明确指定AI回答。

弱介入(Low Priority):消息是事实陈述、观点表达或情感抒发,但其中包含可供AI补充信息或纠正谬误的潜在机会。

不介入(No Intervention):消息是用户间的社交互动、闲聊或与上下文无关的内容。

决策引擎会综合分析以下维度的信息,来完成上述分类。

这个引擎的存在,使得ChatGPT的行为模式从一个被动的“问答机”转变为一个主动的、具备“社交智慧”的“对话参与者”。它在保证AI价值最大化的同时,最大限度地降低了对人类自然交流的干扰。

⚙️ 二、交互机制的深度剖析

一个成功的多人协作工具,其交互设计必须直观、高效且符合用户心智。ChatGPT群聊功能在交互层面的创新,尤其体现在其对成本、效率和趣味性的精妙平衡上。

2.1 速率限制的创新设计:成本与体验的双赢

在传统的API计费模式下,将大模型引入群聊是不可想象的。一个活跃的群组每小时可能产生数百条消息,如果每条消息都经过AI处理并计费,其成本将是天文数字。OpenAI提出的**“仅在ChatGPT实际发言时计入速率限制”**的方案,堪称一项颠覆式创新。

2.1.1 技术实现逻辑

这个机制的背后,是两阶段处理架构。

第一阶段(轻量级监听):所有用户间的消息,都只经过前述的“智能介入决策引擎”进行快速分析。这个引擎本身可以是一个规模小得多的模型,甚至是一个基于规则和启发式算法的系统。它的计算成本极低,几乎可以忽略不计。只有当引擎判断需要AI介入时,才会进入第二阶段。

第二阶段(重量级生成):一旦触发介入,系统才会将完整的、结构化的上下文打包,发送给GPT-5.1大模型进行处理和生成回应。只有这个阶段的调用,才会被计入用户的速率限制和配额。

这种设计,从根本上解决了AI在群聊场景中的成本难题。它确保了计算资源只被用在“刀刃上”,用户可以无后顾之忧地进行自由讨论。

2.1.2 与传统模式的对比

2.2 显式调用与隐式感知:控制与智能的平衡

交互设计的另一个核心,是在用户控制权和AI自主性之间找到最佳平衡点。ChatGPT群聊通过“显式调用”和“隐式感知”的组合,优雅地解决了这个问题。

显式调用 (

@ChatGPT):这是用户掌握绝对控制权的体现。它为用户提供了一个确定性的、可预期的与AI交互的方式。当用户需要AI执行特定任务(如“@ChatGPT,总结一下我们刚才的讨论”)时,这个机制保证了AI必定响应。它就像团队中的一个可靠成员,随时听候差遣。隐式感知:这是AI智能性的体现。在没有被明确呼叫时,AI并非离线,而是在“静默聆听”。它通过智能介入决策引擎,自主判断何时应该主动提供帮助。例如,当群内成员争论一个技术细节而陷入僵局时,AI可能会主动提供相关的官方文档链接。这种“雪中送炭”式的帮助,能带来极大的惊喜感和价值感。

这种双模交互机制,既避免了AI的过度干扰,又防止了其在关键时刻的缺位,让用户感觉AI既“听话”又“懂事”。

2.3 个性化生成与用户画像:从通用到专属

群聊功能的另一个亮点,是其初步展现的个性化能力,尤其体现在引用群成员头像进行图片生成上。这看似一个简单的趣味功能,背后却预示着一个重要的技术方向,即在会话中动态构建和利用临时用户画像(Ad-hoc User Profile)。

2.3.1 动态用户画像的构建

当一个群聊会话开始时,系统会为每个参与者创建一个临时的画像向量。这个画像不仅包含用户的ID、名称、头像引用等静态信息,还会动态地更新以下内容。

语言风格:用户是倾向于使用正式语言还是口语化表达?

交互偏好:用户是更喜欢向AI提问,还是更喜欢与其他成员讨论?

知识领域:从用户的发言内容中,可以推断出其专业领域或兴趣点。

这些信息使得AI的回应更具个性化。例如,在与一位程序员对话时,AI可能会更多地使用代码示例;而在与一位设计师对话时,则可能更多地生成图片或提供视觉灵感。

2.3.2 个性化内容生成的实现

以“用头像生成图片”为例,其技术流程大致如下。

指令解析:用户发出指令,如“@ChatGPT,帮我把@user_Bob的头像变成宇航员”。

实体链接:系统识别出

@user_Bob,并从上下文管理器中检索到其对应的头像引用avatar_hash_456。多模态Prompt构建:系统构建一个包含图像和文本的多模态Prompt。这个Prompt可能类似于

[Image: avatar_hash_456] + [Text: "An astronaut, photorealistic style"]。调用多模态模型:将该Prompt发送给具备图像生成能力的模型(如DALL-E 3),生成最终图片。

结果返回:将生成的图片展示在群聊中。

这个功能虽然小,但它验证了一条重要的技术路径,即AI能够利用会话内的即时信息,进行高度定制化的、多模态的内容创作。这为未来更复杂的个性化协作奠定了基础。

🚀 三、核心应用场景与协作价值重塑

%20拷贝.jpg)

理论的探讨最终要落脚于实践。ChatGPT群聊功能的价值,体现在其对现有团队工作流的深度改造和效率赋能上。它并非简单地在聊天工具中加入一个机器人,而是为多种协作场景提供了全新的解题思路。

3.1 从发散性头脑风暴到结构化创新

头脑风暴是创新的起点,但也常常陷入低效、发散、无结论的困境。ChatGPT在其中可以扮演多种关键角色,将混乱的思维碰撞引向结构化的成果产出。

创意催化剂 (Idea Catalyst):当讨论陷入僵局时,一句“@ChatGPT,基于‘环保’和‘共享经济’,给出五个创业点子”就能瞬间打破沉默,注入新的可能性。

批判性思维伙伴 (Devil's Advocate):团队对某个方案过于乐观时,可以指令“@ChatGPT,请从技术、市场和财务三个角度,指出我们这个方案的最大风险”。AI的客观中立,能有效补充团队思维的盲点。

信息整合者 (Information Synthesizer):经过半小时的激烈讨论后,群聊可能已经积累了上百条信息。此时,“@ChatGPT,总结我们刚才关于A方案的优缺点,并列出待定问题”可以将发散的讨论收敛为清晰的纪要。

知识检索库 (Knowledge Base):讨论中遇到不确定的技术概念或市场数据时,无需切换应用去搜索引擎。直接在群内提问,AI能即时提供精准、可靠的信息支持,保持讨论的连贯性。

3.2 敏捷开发与技术攻坚

对于技术团队,群聊功能的应用场景更为垂直和深入,能够无缝嵌入到代码审查、架构设计和问题排查等核心环节。

3.2.1 异步代码审查 (Asynchronous Code Review)

开发者可以将代码片段或Git提交链接发到群里,并@ChatGPT执行特定检查。这极大地提升了代码审查的效率和深度。

传统流程:开发者A提交代码 -> 等待开发者B有空 -> B进行人工审查 -> 提出修改意见 -> A修改并再次提交。

AI增强流程:开发者A提交代码并

@ChatGPT,检查这段代码是否符合PEP8规范,并找出潜在的性能瓶颈-> AI立即给出初步反馈 -> A在等待人工审查前就完成初步修正 -> B的审查可以更专注于业务逻辑。

3.2.2 架构设计与方案选型

在技术选型阶段,团队往往需要在多个方案间权衡。AI可以作为中立的技术顾问,提供数据驱动的决策支持。

3.2.3 紧急故障排查 (Incident Troubleshooting)

当线上出现紧急故障时,每一秒都至关重要。AI可以帮助团队快速定位问题、协同作战。

日志分析:运维人员将报错日志粘贴到群里,

@ChatGPT,分析这段Java堆栈溢出日志,最可能的原因是什么?指令生成:定位到问题后,

@ChatGPT,生成一个用于检查Linux服务器磁盘空间的shell命令。复盘报告:故障解决后,

@ChatGPT,根据我们的对话记录,生成一份本次故障的复盘报告(Incident Report),包括时间线、根本原因和改进措施。

3.3 内容创作与营销策划

在创意和营销领域,ChatGPT群聊同样能发挥巨大作用,将AI的生成能力与团队的策划智慧有机结合。团队可以在同一个空间内,完成从策略制定到内容产出的全链路工作。

市场分析:

@ChatGPT,分析当前社交媒体上关于“露营”话题的热点趋势和用户情绪。文案生成:

@ChatGPT,为我们的新款帐篷写三条不同风格的推广文案,分别面向家庭用户、专业玩家和情侣。视觉创意:

@ChatGPT,用成员@Alice的头像,生成一张她在星空下露营的卡通风格图片。多语言翻译:

@ChatGPT,将最终确定的文案翻译成日语和韩语。

🔭 四、未来演进方向与行业影响

%20拷贝.jpg)

ChatGPT群聊功能的试点,仅仅是一个开端。它所揭示的,是一个将AI原生嵌入所有协作流程的宏大愿景。从目前透露的信息和技术发展趋势看,其未来的演进将围绕更深的个性化、更广的集成度和更强的平台化展开。

4.1 深度个性化与AI角色扮演

未来的群聊功能,将允许用户对AI进行更深度的定制,甚至为其分配特定的“角色”。

4.1.1 可定制的AI个性

用户将可以调整AI的沟通风格,使其更符合团队文化。例如,可以选择“严谨的学者”、“幽默的伙伴”或“简洁的执行者”等多种预设人格。这种定制化将使AI的交互不再是千篇一律的,而是真正融入团队的氛围中。

4.1.2 任务导向的角色扮演

更进一步,AI可以被赋予明确的团队角色。

项目经理 (Scrum Master):

@ChatGPT,从现在开始,你担任本项目的Scrum Master。请每天早上9点提醒我们开站会,并跟进每个人的任务进度。产品测试员 (QA Tester):

@ChatGPT,扮演一个挑剔的用户,测试我们刚刚设计的产品流程,并提出可能让用户感到困惑的地方。财务分析师 (Financial Analyst):

@ChatGPT,以财务分析师的身份,评估我们这份商业计划书的可行性,重点关注成本和盈利预测。

这种角色扮演能力,将把AI从一个信息提供者,提升为一个具备特定专业技能的虚拟专家。

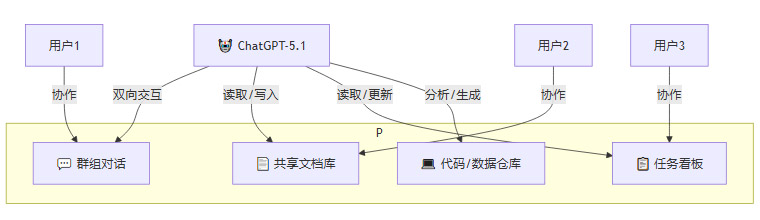

4.2 “共享项目”范式:超越聊天的协作平台

当前的功能仍以“聊天”为中心。而OpenAI正在探索的**“共享项目(Shared Project)”**模式,预示着一次更大的范式革命。它将把ChatGPT从一个聊天应用,升级为一个一站式的智能协作平台。

在这个范式下,一个“项目”不再仅仅是一段对话历史。它是一个包含了多种资源的持久化工作空间。

在这个集成环境中,AI的能力将被彻底释放。它不再局限于处理文本对话,而是能够理解和操作项目中的所有资产。

跨资产的关联理解:用户可以发出这样的指令:“@ChatGPT,根据共享文档库里的‘市场调研报告.docx’,在任务看板上为‘设计团队’创建相关的设计任务,并设定截止日期”。

自动化的工作流:当代码仓库中有一个新的合并请求(Pull Request)时,可以自动触发AI在群组对话中通知相关人员,并初步分析代码变更的风险。

主动的项目洞察:AI可以定期扫描整个项目空间,主动提出建议:“我注意到任务看板上的‘用户反馈处理’任务积压严重,同时共享文档库里的‘FAQ.md’很久没有更新了,建议优先处理这些反馈并更新文档”。

4.3 对协同办公软件市场的冲击

ChatGPT群聊功能的出现及其未来的演进方向,将对现有的协同办公软件市场(如Slack, Microsoft Teams, Lark)构成深远影响。

从“集成AI”到“AI原生”:现有工具大多是在其原有架构上“集成”AI功能,AI更像一个插件。而ChatGPT代表的“AI原生”协作平台,其所有功能都围绕AI构建,交互更流畅,智能程度更高。这将迫使传统厂商加速其AI化的底层改造。

竞争维度的升维:未来的协作软件竞争,将不再仅仅是功能多寡的竞争,而是平台智能水平的竞争。谁能提供更“懂”团队工作流的AI,谁就将在竞争中占据优势。

重塑工作技能:对于职场人士而言,与AI高效协作的能力(即所谓的“AI商”)将变得至关重要。如何提出精准的指令、如何解读AI的输出、如何引导AI参与复杂的团队决策,将成为一项新的核心职业技能。

结论

ChatGPT群聊功能的试点,远不止是增加了一个多人聊天窗口。它是一次精心设计的技术与产品实验,旨在探索AI作为核心参与者融入人类群体智慧活动的全新范式。通过基于GPT-5.1的强大模型能力、创新的速率限制机制以及智能的交互设计,OpenAI成功地解决了AI在多人协作场景中的三大核心痛点:高昂的成本、频繁的干扰和有限的价值。

从扮演团队中的信息检索员、创意激发者,到未来可能成为项目管理者、虚拟专家,ChatGPT正在稳步地从一个“无所不知的个人助理”向一个“无所不能的团队伙伴”进化。其最终目标,是构建一个以AI为操作系统、以数据和知识为驱动力的新一代智能协作平台。这条路虽然刚刚起步,但它所指向的,无疑是人机协同的下一个黄金时代。

📢💻 【省心锐评】

ChatGPT群聊的核心并非聊天,而是将AI原生嵌入团队工作流。它改变了协作的原子单位,从“人-人”交互,演变为“人-AI-人”的智能网络。

.png)

评论