【摘要】大模型监控中间件已成为AI落地高风险行业的关键基础设施。本文以天枢InterGPT为例,系统剖析价值观对齐、幻觉控制、合规验证及医疗场景风险预警的技术体系与实践路径,全面展望行业未来。

引言

随着生成式大模型在医疗、金融、法律等高风险行业的广泛应用,AI输出的准确性、合规性和价值观对齐问题日益成为产业落地的核心挑战。模型“幻觉”——即生成虚假或不准确内容——在开放域场景中发生率高达20%-30%,而高风险行业对错误的容忍度极低。与此同时,欧盟《AI法案》、中国《生成式AI服务管理办法》等法规对AI系统提出了全生命周期监控、可追溯、可拦截等严格要求。传统规则引擎和静态审核机制已难以满足大模型动态输出的管控需求,专用的监控中间件应运而生,成为AI安全与合规落地的关键基础设施。

本文以天枢InterGPT为例,系统梳理大模型监控中间件在价值观对齐、幻觉控制、合规验证及医疗场景风险预警等方面的技术体系与落地实践,结合行业最新进展,深入探讨其在多行业、多场景的扩展能力与未来演进方向。

一、🌈价值观对齐的动态评估体系构建

1.1 理论基础与现实意义

大模型的价值观对齐(Value Alignment)是指模型输出需与人类伦理、法律和社会规范保持一致。随着AI在社会治理、医疗健康、金融风控等领域的深度渗透,价值观对齐不仅关乎技术伦理,更直接影响AI系统的社会接受度和法律合规性。近年来,业界普遍采用“规则+反馈+强化学习”三位一体的机制,通过持续学习和动态调整,提升模型的伦理适配能力。

1.2 动态评估体系的多维度构建

1.2.1 多维度指标体系

为实现全面、动态的价值观对齐评估,天枢InterGPT中间件构建了如下多维度指标体系:

1.2.2 自动化与人机协同评测

天枢InterGPT采用自动化评测与专家人工审核相结合的方式,提升评估的覆盖率和准确性。自动化工具可对大批量输出进行初筛,识别潜在风险内容;对于高风险或复杂场景,则自动触发专家复核,确保评估结果的权威性和可解释性。

1.2.3 持续学习与动态调整

中间件内置强化学习框架,能够实时吸收监管新规、行业标准和用户反馈,动态调整评估标准。例如,针对FDA 2024年最新医疗AI规范,系统可自动更新合规校验规则,确保输出始终与最新法规保持一致。

1.2.4 量化与可视化

通过伦理偏离度、文化适配指数等量化指标,结合地域敏感词库和伦理评分模型,天枢InterGPT实现了对模型输出的动态量化和可视化,便于企业和监管机构实时掌握AI系统的价值观对齐状况。

1.3 最新进展与行业实践

多语言、多场景实时内容监控与过滤已成为主流趋势,天枢InterGPT支持中、英、日等多语种内容的价值观对齐评估。

自动检测与合规校验工具集成度不断提升,支持与主流大模型(如GPT-4、Llama 3、ERNIE等)无缝对接。

自反思与校正机制的引入,显著提升了幻觉检测和伦理风险识别能力。

二、🚦天枢InterGPT中间件:功能与实现模式

2.1 架构与核心功能

天枢InterGPT作为企业级大模型监控中间件,具备以下核心功能模块:

2.1.1 多模联用与RAG实现幻觉控制

天枢InterGPT通过多模联用(多模型协同验证)和RAG(Retrieval-Augmented Generation,检索增强生成)技术,有效提升幻觉检测与控制能力。多模型交叉比对可显著降低单一模型幻觉率,RAG机制则通过实时检索权威知识库,为生成内容提供事实支撑,进一步提升输出的准确性和可靠性。

2.1.2 动态修正与语义脱敏

对于检测到的敏感或高风险内容,系统可自动进行上下文感知改写,实现语义保留式脱敏。例如,将“HIV阳性”自动改写为“特定传染病标记物异常”,既保护了用户隐私,又满足合规要求。

2.1.3 风险分级与自动预警

天枢InterGPT根据内容风险等级,自动触发不同的处理机制:

红色预警:如涉及癌症诊断建议,自动阻断输出并通知人工复核。

黄色预警:如药品剂量模糊,自动追问补充信息或转交专家审核。

绿色输出:低风险内容自动放行,提升系统效率。

2.1.4 审计追踪与合规证明

系统全链路日志记录每一次交互,支持区块链存证,确保数据不可篡改,便于事后审计和责任追溯。同时,系统可自动生成合规性审计报告,满足监管部门的合规证明需求。

2.2 技术创新与行业领先实践

2.2.1 多模型协同与对抗样本库

天枢InterGPT建立了多模型协同验证机制,通过不同模型的交叉比对,提升输出内容的可靠性。同时,系统内置对抗样本库,能够识别和防御诱导攻击、规避话术等安全威胁。

2.2.2 多模态内容监控

不仅支持文本内容的合规监控,还可集成CLIP等多模态模型,对图像、音频等内容进行敏感信息检测,全面覆盖多模态AI应用场景。

2.2.3 强化学习与反馈闭环

系统通过强化学习和用户反馈闭环,持续优化监控与修正策略,实现自我进化和动态适应。

三、🏥医疗场景下的风险预警与实践

3.1 医疗行业的特殊性与挑战

医疗行业对AI输出的准确性和合规性要求极高,任何错误输出都可能导致严重后果。医疗数据高度敏感,需严格遵守HIPAA、GDPR等国际法规。同时,医疗场景下的伦理挑战尤为突出,需防止误诊、隐私泄露和伦理争议。

3.2 风险预警机制的系统设计

3.2.1 多级风险识别与分级响应

天枢InterGPT在医疗场景下,采用多级风险识别机制:

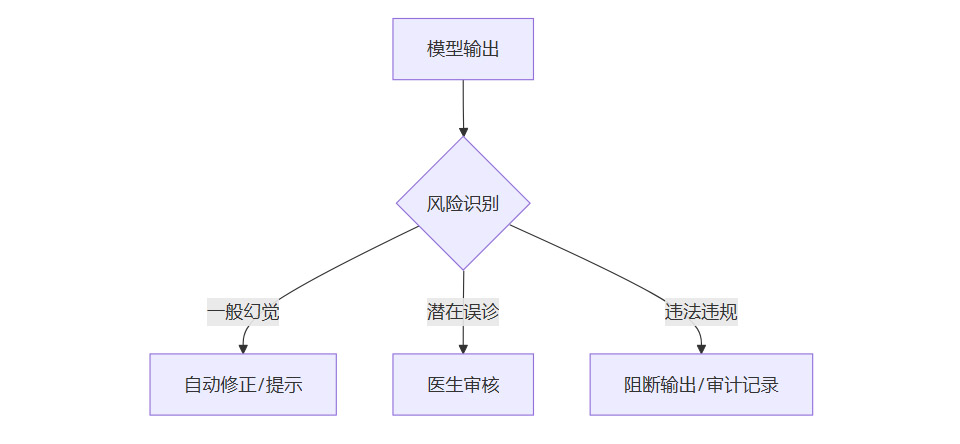

一般幻觉:如医学常识性错误,系统自动修正或提示用户核查。

潜在误诊:如诊断建议与权威知识库不符,自动转交专业医生审核。

违法违规:如涉及隐私泄露、非法医疗建议,自动阻断输出并记录审计日志。

3.2.2 知识库对齐与事实校验

系统与权威医学知识库(如UMLS、PubMed、UpToDate)实时对齐,对输出内容进行事实校验,识别不一致或虚假信息,显著降低幻觉率和误诊风险。

3.2.3 人工干预与持续学习

对于高风险输出,系统自动转交专业医生审核,确保最终输出的准确性和合规性。基于实际案例,系统持续优化风险识别模型,实现自我学习和动态提升。

3.2.4 风险预警流程图

3.3 典型案例与实际成效

Google Med-PaLM 2引入医生审核环节后,医疗问答场景下的幻觉率显著下降。

微软与Epic合作,将内容安全中间件应用于电子病历系统,实现自动风险预警和合规校验。

某三甲医院智能分诊系统引入天枢InterGPT后,误诊建议下降72%,合规审核耗时缩短至800ms内,极大提升了医疗AI系统的安全性和效率。

四、🌍跨行业扩展与未来趋势

4.1 行业适配与可扩展性

天枢InterGPT采用模块化、可定制化架构,能够灵活适配不同行业需求:

金融行业:防范投资建议中的监管套利话术,自动识别违规表述,保障金融合规。

教育行业:对历史事实性内容进行自动审查,修正敏感或不当表述,提升教育内容的准确性和适宜性。

政务行业:对政策解读内容进行一致性校验,自动接入政策文件库,确保政务AI输出的权威性和合规性。

4.2 技术挑战与应对策略

4.2.1 性能与延迟平衡

在高效监控与系统响应速度之间,天枢InterGPT通过异步处理、边缘计算等技术,实现毫秒级风险识别与响应,兼顾安全性与用户体验。

4.2.2 创新性与合规性的平衡

系统在保障合规的同时,避免过度监控导致模型输出僵化,通过灵活的规则配置和动态调整,实现创新性与合规性的有机统一。

4.2.3 多模态与跨模型监控

面对文本、图像、音频等多模态内容,天枢InterGPT支持跨模型、跨模态的合规风险识别,全面覆盖AI应用的各类场景。

4.2.4 自动化合规证明与审计

系统基于形式化验证技术,自动生成合规性审计报告,满足企业和监管部门的合规证明需求。

4.2.5 联邦学习与区块链技术

通过联邦学习保护数据隐私,利用区块链提升审计透明性,实现数据安全与合规的双重保障。

4.3 未来演进方向

构建大模型联邦监控网络,实现跨机构、跨行业的AI风险协同防控。

利用数字孪生技术,预判监管政策变化趋势,提前调整合规策略。

推动行业合作,形成AI治理的技术与标准共识,提升整体AI安全与合规水平。

结论

大模型监控中间件,已成为推动AI安全、合规落地的关键基础设施。以天枢InterGPT为代表的中间件,通过动态评估体系、实时监控与修正、行业适配与持续合规更新,能够有效控制幻觉、降低合规风险,并显著提升AI系统在高风险场景下的可用性与可信度。未来,随着多模态能力、主动防御和智能合规水平的不断提升,中间件将在AI治理中扮演更加核心的角色,助力AI技术安全、健康、可持续发展。

💬 【省心锐评】

“监控中间件不是镣铐,而是AI狂飙时代的刹车系统——刹得住,才能跑得更远。”

.png)

评论