【摘要】微软Live Interpreter API的发布,正悄然逆转全球沟通的“巴别塔”困境。这项技术凭借自动语言识别、低延迟同传体验及革命性的“个人声音”克隆功能,实现了76种语言的无缝实时交流。它不仅是技术的跃迁,更预示着商务、教育、社交等领域协作范式的深刻变革,让真正无感的跨语言沟通成为现实。

引言

自古以来,人类便梦想着跨越语言的鸿沟。在那个名为“巴别”的古老传说中,一座通天塔的崩塌,让人类从此言语不通,四散各地。这个故事,成为了千百年来横亘在全球协作与文化交融面前的一道隐喻之墙。无数的翻译官、学者与工程师,都在用自己的方式,尝试重建这座沟通之塔。

从笨拙的词典,到基于规则的机器翻译,再到统计机器翻译的兴起,我们一步步接近目标。然而,真正的突破始于神经网络与深度学习的浪潮。即便如此,实时、自然、带有情感的语音同声传译,依然像神话一样遥远。我们习惯了延迟,习惯了机械的电子音,习惯了在沟通前繁琐地选择“源语言”和“目标语言”。

现在,这个神话或许正在被终结。微软于2025年9月13日发布的Live Interpreter API,如同一声惊雷,在技术圈内激起千层浪。它并非一次简单的功能迭代,而是一次对实时翻译体验的彻底重塑。它让机器翻译悄然后退,把舞台的中央重新还给了“人”与“沟通”本身。这篇文章,将带你深入剖析这项被誉为“语言核弹”的技术,从它的历史脉络、核心机制,到应用场景与成本考量,全面解读它如何逆转巴别塔的魔咒。

一、📜 技术溯源,从实验室到“语言核弹”

任何一项颠覆性技术的诞生,都不是一蹴而就的。微软Live Interpreter API的背后,是其在机器翻译领域近二十年的深耕与演进。这条技术路径,清晰地展示了从文本到语音、从静态到实时、从通用到个性的发展轨迹。

1.1 奠基时代(2007-2015)· 文本翻译的深厚积累

微软的翻译征程,始于内部需求。早在2007年,Microsoft Translator服务便已在微软内部广泛应用,为其全球化业务提供支撑。这段时期,主流技术还是统计机器翻译(SMT),它通过分析海量的双语语料库,学习词语和短语之间的翻译概率。

2011年,微软迈出了关键一步,将这项内部能力通过API的形式向外部开发者开放。这使得无数第三方应用和服务得以集成微软的翻译能力,极大地拓展了其生态。

2012年,在一次公开的技术演示中,微软研究院的负责人里克·雷斯特(Rick Rashid)展示了一项震惊四座的技术。他用英语演讲,系统几乎同步地将他的话翻译成中文,并且,合成的中文语音还模仿了他的音色。这便是Live Interpreter API“个人声音”功能的雏形,一颗在十多年前就已埋下的种子。

这个阶段,微软积累了海量的多语言数据,并初步探索了语音翻译的可能性,为后续的飞跃打下了坚实的基础。

1.2 突破时代(2016-2024)· 神经网络与实时应用的崛起

2016年是机器翻译领域的分水岭。以**神经机器翻译(NMT)**为代表的深度学习技术,彻底取代了SMT。NMT模型能够理解更长的上下文,生成的译文在流畅度和准确性上实现了质的飞跃。微软迅速抓住了这次技术浪潮。

2016年,微软推出了Translator live功能,这是一个允许多人、多设备、跨语言实时交流的应用。用户可以通过手机或电脑加入一个会话,用自己的语言发言,其他参与者则能看到或听到翻译后的内容。这标志着微软的实时翻译技术开始从实验室走向大众应用。

2021年,微软进一步推出了文档翻译功能,能够完整保留原始文档的格式和布局,对企业级应用意义重大。

在这一时期,微软不仅完成了底层技术的代际更迭,还在产品形态上不断探索,积累了丰富的实时多语言交互场景的工程经验。

1.3 巅峰之作(2025)· Live Interpreter API的诞生

经过多年的技术迭代和经验积累,微软终于在2025年9月13日,正式发布了集大成者——Live Interpreter API,并开放公共预览。它的出现,并非简单的功能叠加,而是将多项尖端技术无缝融合,实现了体验上的跃迁。

它的发布之所以被业界称为“语言核弹”,是因为它一举解决了实时语音翻译中最棘手的几个痛点,让理想中的同声传译体验,第一次如此接近现实。

二、⚙️ 核心解构,API背后的三大技术支柱

Live Interpreter API的魔力,源于其背后三大核心技术的无缝协同。它们分别是自动连续的语言识别、极致优化的低延迟翻译流,以及最具颠覆性的**“个人声音”克隆技术**。

2.1 支柱一 · 自动语言识别与无缝切换

在传统的多语言会议中,一个常见的痛点是需要频繁手动切换翻译通道,或者在发言前声明自己将要使用的语言。这种操作不仅繁琐,还常常打断沟通的自然流畅性。

Live Interpreter API彻底改变了这一现状。它内置了**持续语言识别(Continuous Language Identification, LID)**模型。

2.1.1 工作原理简析

该模型能够实时分析输入的音频流,在极短的时间内(通常是几百毫秒)判断出说话者正在使用的语言。它的强大之处在于“持续”二字。

无需预设 用户无需在开始时告诉系统“我要说英语”。系统会像一个精通多国语言的人类助手一样,静静地“聆听”。

动态切换 在一场对话中,如果一位发言者从英语无缝切换到法语,LID模型能迅速捕捉到这一变化,并自动调整后续的翻译任务,整个过程用户毫无察觉。

高鲁棒性 它能有效处理口音、语速变化甚至短暂的背景噪音,在复杂的真实环境中保持高准确率。

这项功能的支持范围极为广泛,覆盖了76种输入语言和143个地区,足以应对全球绝大多数的商业和文化交流场景。真正的无障碍交流,始于无需操作的自由。

2.2 支柱二 · 低延迟、媲美人工口译的体验

实时翻译的“实时”,是衡量其可用性的核心标准。延迟过高,会让对话变得断断续续,体验极差。Live Interpreter API通过对整个翻译流程的极致优化,将延迟压缩到了几乎可以忽略不计的水平。

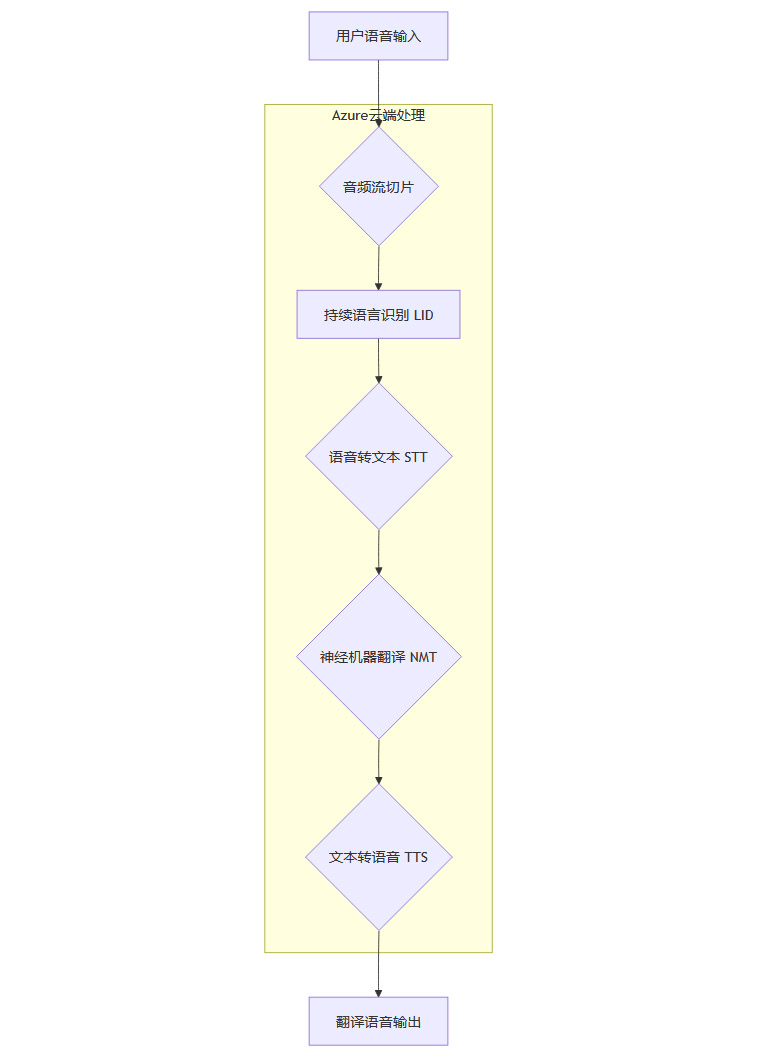

我们可以通过一个简化的流程图来理解其工作流。

为了实现低延迟,微软在每一个环节都进行了深度优化。

流式处理 整个过程并非“录完一整句再翻译”,而是采用流式处理。音频数据被切成微小的数据块,一边传输一边处理,后续环节无需等待前一环节完全结束。

预测与并行 先进的模型可以在一句话还没说完时,就开始预测后续内容并启动翻译。STT、NMT和TTS三个核心任务在云端高度并行,最大化地利用计算资源,缩短处理时间。

全球网络 依托Azure遍布全球的数据中心和网络,API能够确保用户就近接入,从物理层面减少数据传输的延迟。

最终的效果,是用户几乎在话音落下的同时,就能听到高质量的翻译输出,其流畅度足以媲美经验丰富的人类同声传译员。

2.3 支柱三 · “个人声音”功能,让翻译拥有温度

如果说前两项技术解决了“通顺”和“快速”的问题,那么**“个人声音”(Personal Voice)**功能则解决了翻译的“灵魂”问题——让翻译听起来像“你”在说。

这是本次发布中最令人惊艳的创新。传统的TTS(文本转语音)无论多么流畅,输出的都是预设的、标准化的“机器音”,与说话者本人的情感和风格完全脱节。而“个人声音”功能,通过声音克隆技术,彻底改变了这一点。

2.3.1 技术揭秘

这项功能背后是复杂的个性化语音合成模型。其基本原理是。

声音采样 系统只需要用户提供一小段清晰的语音样本(可能只需几分钟甚至更短)。

声纹建模 深度学习模型会从样本中学习和提取说话者独特的声学特征,包括音色(Timbre)、音高(Pitch)、语调(Intonation)、节奏(Rhythm)和韵律(Prosody)。

模型生成 基于这些特征,系统会为该用户生成一个专属的个性化语音模型。

实时合成 当翻译任务完成后,NMT输出的文本会交由这个个性化模型进行语音合成。最终,听众听到的不再是冰冷的机器音,而是保留了原说话者风格和特质的翻译语音。

下表清晰地对比了传统TTS与“个人声音”功能的区别。

2.3.2 安全与伦理考量

声音克隆技术无疑是强大的,但同时也带来了关于滥用和隐私的担忧。微软对此高度重视,为API配备了企业级的隐私保护和同意控制机制。

明确授权 用户必须明确同意并主动提供自己的声音样本,才能创建个人语音模型。

数据隔离 用户的声纹数据受到严格的加密和隔离保护,防止未经授权的访问。

使用监控 平台会对API的调用进行监控,防止恶意生成或滥用他人声音。

这种负责任的设计,确保了技术在释放巨大价值的同时,也能在安全和合规的框架内运行。

三、🌐 应用蓝图,重塑全球沟通范式

%20拷贝-mtau.jpg)

一项技术的真正意义,在于它能解决什么问题,创造什么价值。Live Interpreter API的应用前景极为广阔,它将作为一种基础设施,渗透到各个行业,重塑现有的沟通与协作模式。

3.1 国际会议与多语言活动

这是最直接、最显而易见的应用场景。传统的同传设备租赁昂贵、设置复杂,且需要专业译员。

之前 与会者需要佩戴耳机,手动选择语言频道。组织方需要投入大量成本在同传箱和译员上。

之后 任何一个会议软件或活动App,只需集成Live Interpreter API,与会者便能通过自己的手机或电脑,实时听到带有主讲人个人风格的母语翻译。这不仅降低了成本,更提升了会议的包容性和参与感。

3.2 在线教育与知识共享

语言是知识传播的最大障碍之一。全球顶尖的课程和讲座,往往因为语言问题而受众有限。

之前 学生要么依赖质量参差不齐的字幕,要么等待漫长的翻译和配音过程。

之后 一位身在硅谷的教授,他的在线课程可以被全球各地的学生实时收听。学生听到的不仅是翻译精准的母语内容,更是保留了教授讲课时抑扬顿挫、充满激情的原声风格。这极大地提升了学习体验和知识吸收效率,推动教育公平。

3.3 多语言客户支持中心

对于跨国企业而言,建立一个覆盖全球的多语言客服中心成本高昂。

之前 企业要么在各地设立本土化团队,要么让客户在漫长的IVR语音导航中寻找自己语言的坐席。

之后 企业可以建立一个集中的“超级客服中心”。任何一位客服人员,都可以用自己的母语,与来自全球任何地方、说任何语言的客户进行流畅、实时的语音沟通。这不仅能显著降低运营成本,还能大幅提升客户满意度。

3.4 社交电商与全球直播

直播带货已成为一种重要的商业模式,但其影响力往往局限于单一语言市场。

之前 主播难以与使用其他语言的观众进行有效互动,限制了商品的全球触达。

之后 一位中国的主播,在直播时,他的声音可以被实时翻译成英语、西班牙语、日语等多种语言,并且保留他富有感染力的叫卖风格。全球的观众都能无障碍地参与抢购和互动。这将助力无数品牌和创作者轻松实现全球化,开启一个全新的“全球直播经济”时代。

3.5 智能硬件与物联网生态

API的价值不止于软件。微软已经开始与安克创新(Anker)等硬件厂商合作,探索将API嵌入到智能音频设备中。

未来畅想 想象一下未来的智能耳机、会议麦克风、甚至汽车座舱,都内置了实时同传功能。你戴上耳机,就能听懂全世界。你在车里开一场跨国会议,就像所有人都坐在你身边一样。API与硬件的结合,将让无障碍沟通变得像空气和水一样,无处不在。

四、🛠️ 实践指南,从零到一集成API

对于开发者而言,了解如何获取和集成这项强大的功能至关重要。微软通过Azure云平台,提供了标准且清晰的集成路径。

4.1 准备工作 · 敲开Azure的大门

集成API的第一步,是完成Azure平台的基础设置。

4.2 集成流程 · 四步构建你的翻译应用

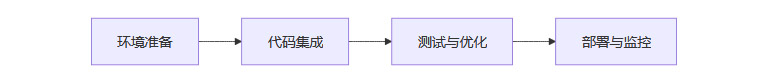

拥有API密钥和终结点后,开发者就可以开始将实时翻译功能集成到自己的应用程序中了。整个流程可以概括为以下四个阶段。

4.2.1 环境准备

根据你的技术栈,选择合适的开发环境和工具。微软官方提供了多种主流编程语言的SDK,包括但不限于。

Python

C# / .NET

Java

JavaScript / Node.js

Go

安装相应的SDK,并配置好你的开发环境,确保可以访问Azure服务。

4.2.2 代码集成

这是核心的开发环节。开发者需要调用SDK提供的接口,实现语音的捕获、发送和接收。一个简化的伪代码逻辑可能如下。

// 1. 配置语音服务

config = SpeechConfig(subscription=API_KEY, region=REGION)

config.set_property(property_id="SpeechServiceConnection_Translation_Features", value="LiveInterpreter")

// 2. 创建翻译器实例

translator = SpeechTranslator(speech_config=config, audio_config=audio_input)

// 3. 注册事件处理函数

translator.recognizing += on_recognizing_event // 处理中间结果

translator.recognized += on_recognized_event // 处理最终结果

// 4. 启动连续识别和翻译

translator.start_continuous_recognition()

// ... 等待用户输入和翻译结果 ...

// 5. 停止翻译

translator.stop_continuous_recognition()

关键在于正确配置LiveInterpreter模式,并处理好相应的事件回调,以实时获取翻译结果并呈现给用户。

4.2.3 测试与优化

在开发过程中,需要对应用的性能和用户体验进行充分测试。

延迟测试 在不同网络环境下测试端到端的翻译延迟。

准确性测试 测试不同口音、语速和背景噪音下的翻译准确率。

资源消耗 监控应用在客户端的CPU和内存占用情况。

根据测试结果,对代码逻辑、音频处理方式等进行优化。

4.2.4 部署与监控

应用开发完成后,将其部署到生产环境。同时,利用Azure门户提供的监控工具,持续跟踪API的调用量、错误率和响应时间,确保服务的稳定运行。

五、💰 成本考量,价值与投入的平衡艺术

%20拷贝-hydp.jpg)

强大的功能背后,成本是企业和开发者必须考虑的现实问题。Live Interpreter API作为Azure AI服务的一部分,其定价策略兼顾了灵活性和可扩展性。

5.1 定价模型解析

其成本结构主要遵循Azure的按量计费模式,并为不同规模的用户提供了选择。

需要注意的是, “个人声音”等高级功能可能会有额外的计费项。具体和最新的定价,务必以Azure官网发布的为准。

5.2 成本优化策略

对于希望有效控制成本的开发者和企业,可以采取以下策略。

善用免费额度 对于新项目或小体量应用,充分利用Azure为新用户提供的前12个月的免费额度,可以显著降低初期成本。

选择合适的区域 将服务资源部署在离你的用户最近的Azure区域,不仅能降低延迟,有时也能因区域定价差异而节省成本。

监控与警报 在Azure门户中设置预算警报。当费用接近预设阈值时,系统会自动通知你,防止意外的超支。

缓存常用翻译 如果你的应用场景中有大量重复的短语或句子,可以在应用层做适当的缓存,避免重复调用API。

评估竞品 在技术选型阶段,可以横向对比其他云厂商(如阿里、腾讯等)提供的类似服务,结合自身业务需求,做出性价比最高的选择。

通过精细化的成本管理,企业可以在享受技术带来巨大价值的同时,将投入控制在合理范围内。

总结

微软Live Interpreter API的发布,不仅仅是一次技术参数的刷新,它更像一个宣言。它宣告了那个需要我们费力去“适应”机器翻译的时代正在过去,一个机器“适应”人、技术“隐身”于无形的新时代正在到来。

从自动识别语言的便捷,到媲美同传的流畅,再到保留个人风格的温度,这项技术正在系统性地拆除沟通中的壁垒。它让全球协作的门槛变得前所未有的低,让知识和文化的传播变得更加高效和普惠。

对于开发者和企业而言,这既是机遇也是挑战。如何利用好这一强大的“语言基础设施”,在自己的产品和服务中创造出全新的用户体验,将是未来几年值得深入思考的课题。

巴别塔的魔咒,正在被代码和算法一点点逆转。我们有理由相信,一个真正“天涯若比邻”的全球化沟通新纪元,已经触手可及。

📢💻 【省心锐评】

微软此举,意不在翻译本身,而在定义下一代“沟通操作系统”的底层标准。当声音和身份可以跨语言无损传递时,真正的全球化数字身份才刚刚开始。

.png)

%20%E6%8B%B7%E8%B4%9D-nuae.jpg)

评论