【摘要】李飞飞主张以人为本的AI发展观,强调空间智能、科学治理与教育创新,反思AGI神话,推动AI赋能全人类。

引言

人工智能(AI)正以前所未有的速度重塑世界。无论是产业变革、社会治理,还是日常生活,AI的影响已无处不在。然而,关于AI的未来,尤其是通用人工智能(AGI)的讨论,始终充满争议与想象。硅谷的科技领袖们热衷于描绘“超级智能”主宰世界的图景,警告AI可能带来的生存威胁,推动着一波又一波的技术与资本浪潮。

在这场喧嚣中,李飞飞博士的声音格外清晰而坚定。她以深厚的学术积淀和产业实践,持续呼吁回归AI的本质——服务人类,赋能社会。2025年,在拉斯维加斯的Ai4会议上,李飞飞与CNN的Matt Egan展开对话,描绘了一个学习、空间推理和沉浸式数字世界共同发展的未来。她反思AGI神话,强调AI与AGI的界限本无本质差异,主张以人为本的AI发展路径。她关注AI的社会影响,倡导科学治理,推动空间智能的突破,并在教育领域探索AI与人类认知的深度融合。

本文将系统梳理李飞飞关于AI未来的核心观点,深入探讨她在AGI界限、AI安全、空间智能、AI治理与教育等领域的独特见解,展现一位AI领军者对技术与人文的深度思考。

一、AGI与AI的界限:本质无分,重在服务人类

1.1 AGI与AI的历史渊源

人工智能的概念自诞生之初,便承载着人类对“智能机器”的无限遐想。图灵、麦卡锡、明斯基等AI奠基人设想的,正是具备广泛能力的智能系统,而非仅限于单一任务的“窄AI”。李飞飞多次强调,AGI与AI之间并无本质区别。她坦言:“我不知道AGI和AI这两个词的区别在哪里。”在她看来,AGI不过是AI发展过程中的一个阶段性目标,而非终极归宿。

1.1.1 术语之争的迷雾

当前业界对AGI的热衷,往往带有概念上的模糊和误解。许多科技公司将AGI作为技术叙事的高地,吸引资本与关注,却忽略了AI真正的价值在于切实服务于人类。李飞飞提醒,过度追逐“超级智能”或陷入术语之争,容易让AI的发展偏离初衷,甚至引发不必要的恐慌与误导。

1.1.2 以人为本的AI愿景

李飞飞始终坚持,AI的核心使命是赋能人类、尊重人类的能动性和价值观。她反对将AI视为潜在威胁或主宰者,更反对将人类置于AI的对立面。她主张,AI应成为人类的合作伙伴,推动社会进步与共同福祉。

1.2 现实应用与社会影响

与部分科技领袖将AGI视为AI终极目标的主流叙事不同,李飞飞更关注AI在现实世界中的实际应用和社会影响。她强调,AI的发展应紧密结合人类需求,解决实际问题,而非沉迷于技术自嗨或未来主义幻想。

1.2.1 赋能社会的AI案例

医疗健康:AI辅助诊断、手术模拟、个性化治疗,提升医疗服务质量与效率。

教育创新:智能化教学、虚拟实验室、个性化学习路径,激发学生潜能。

环境保护:AI驱动的气候建模、资源优化、污染监测,助力可持续发展。

社会治理:智能交通、城市管理、公共安全,提升社会运行效率。

这些案例表明,AI的真正价值在于解决人类面临的复杂挑战,而非追逐抽象的“通用智能”标签。

二、AI安全:科学治理与社会责任

2.1 AI安全的多维度挑战

AI安全问题日益成为全球关注的焦点。从算法偏见、数据隐私,到虚假信息、自动化失控,AI带来的风险多样且复杂。李飞飞认为,AI安全的根本在于强有力的监督机制、良好的系统设计和以人为本的价值观。

2.1.1 现实风险优先级

李飞飞更关注AI带来的“社会灾难性风险”,包括:

虚假信息传播:AI生成内容可能加剧信息污染,影响社会信任。

就业岗位流失:自动化替代传统岗位,带来结构性失业风险。

能源消耗:大模型训练与推理消耗巨量能源,影响环境可持续性。

社会不平等:技术红利集中于少数企业,扩大数字鸿沟。

她主张,通过科学治理、目标设定和公平准入来应对这些现实挑战,而非过度渲染远期的生存威胁。

2.1.2 反对情感绑定的安全幻想

部分AI专家主张为AI植入“母性本能”或关怀情感,以确保AI不会伤害人类。李飞飞坚决反对依赖模拟情感来保障安全。她认为,AI的安全应建立在制度和技术的双重保障之上,而非寄希望于情感绑定或道德灌输。

2.2 AI治理的科学与务实

2.2.1 科学立法与创新平衡

在AI治理立法方面,李飞飞主张在监管与创新之间寻求平衡。她担忧过于严格的监管可能抑制学术界和开源社区的创新活力,导致技术和资源过度集中于少数企业。她强调,政策制定应基于现实能力和数据,而非对AI威胁的过度渲染。

2.2.2 AI治理三大原则

李飞飞提出,AI治理应遵循以下三大原则:

三、空间智能:AI发展的关键突破口

3.1 空间智能的内涵与意义

李飞飞近年来大力推动“空间智能”(Spatial Intelligence),认为这是实现“完整AI”乃至AGI不可或缺的核心能力。空间智能指AI对三维物理和数字世界的理解、推理与创造能力,远超当前主流AI在二维信息处理上的局限。

3.1.1 空间智能的技术愿景

通过World Labs等项目,李飞飞致力于开发能在3D环境中推理、交互和生成内容的AI系统。她指出,人类认知的发展始于空间探索,AI若缺乏空间智能,就如同没有地基的摩天大楼。

3.1.2 空间智能的核心能力

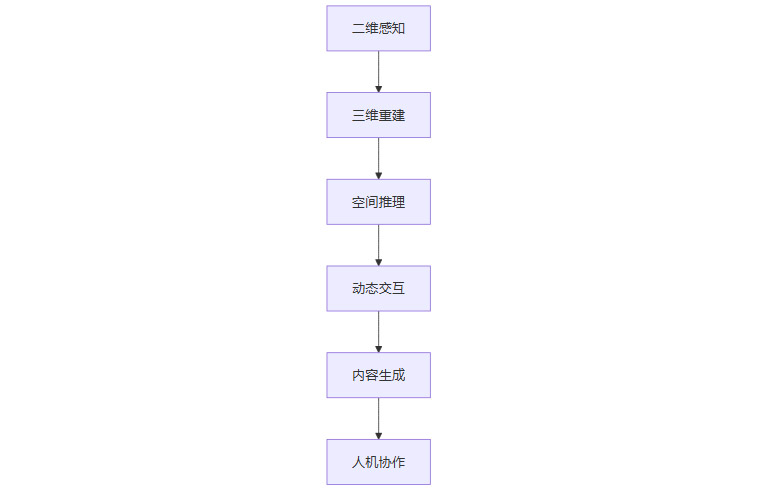

三维感知:理解和重建物理世界的空间结构。

空间推理:在复杂环境中进行路径规划、目标识别与动态交互。

内容生成:创造虚拟3D场景、角色与物体,实现沉浸式体验。

3.1.3 空间智能的技术路径

李飞飞认为,空间智能的实现是AI能力跃迁的关键。其技术路径可用如下Mermaid流程图直观展现:

这一路径清晰地展现了AI从基础的二维感知,逐步进化到三维重建、空间推理、动态交互,最终实现内容生成与人机协作的完整链路。每一步都是AI迈向“完整智能”的关键台阶。

3.2 空间智能的应用场景

空间智能的突破,将为AI赋能带来全新可能。以下表格梳理了空间智能的典型应用场景:

3.2.1 技术瓶颈与未来方向

李飞飞批评当前如OpenAI Sora等模型仍局限于二维,强调空间智能才是AGI的未来方向。她希望通过空间智能推动AI从“感知智能”向“行动智能”转变,实现人机协作和赋能。

四、AI治理与社会责任:科学、务实、赋能生态

4.1 科学治理的现实路径

李飞飞主张,AI治理应依靠科学而非科幻,务实而非意识形态化。她强调,政策制定应基于现实能力和数据,避免对AI威胁的过度渲染。她反对将AI治理工具化或政治化,主张以实际效果为导向,推动社会福祉最大化。

4.1.1 赋能AI生态系统

李飞飞呼吁,鼓励开放创新、多元合作,防止技术和资源过度集中于少数企业。她认为,只有构建包容、开放的AI生态,才能确保技术红利惠及全人类。

4.1.2 关注社会公平与可持续发展

她特别关注社会公平、数据隐私、能源消耗等现实问题,主张推动公共部门和开源社区的广泛参与,确保AI技术造福全人类。

4.2 AI治理的全球视野

4.2.1 国际合作与标准制定

AI的影响早已超越国界,李飞飞强调,全球范围内的合作与标准制定至关重要。她呼吁各国政府、企业、学术界共同参与AI治理,推动技术、伦理与法律的协同发展。

4.2.2 公共部门与开源社区的角色

李飞飞认为,公共部门和开源社区在AI治理中扮演着不可替代的角色。他们不仅推动技术创新,更保障了技术的开放性与可及性,为社会公平与多元发展提供坚实基础。

五、教育中的AI:苏格拉底式对话与好奇心

%20拷贝-hubc.jpg)

5.1 AI在教育中的角色转变

在教育领域,李飞飞强调,AI应成为“苏格拉底式”的对话工具,激发学生的好奇心和批判性思维,而非仅仅作为获取答案的捷径。她反对将AI与学术不诚实简单划等号,认为应更多关注如何利用AI提升学习者的能力和探索精神。

5.1.1 AI赋能学习的路径

个性化学习:根据学生兴趣和能力,定制学习内容与进度。

智能对话:通过AI进行深度问答,培养批判性思维与创新能力。

虚拟实验:构建沉浸式实验环境,提升实践与探索体验。

协作学习:促进学生间的合作与交流,增强团队意识。

5.1.2 “提示”作为探索的起点

李飞飞主张,“提示”应是探索的起点,而非终点。她鼓励学生通过AI进行调查和思考,将AI视为激发好奇心与创造力的伙伴,而非简单的工具或答案提供者。

六、以人为本的AI未来

6.1 AI与人类的协作共生

李飞飞的AI观念贯穿“以人为本”,主张AI是人类的合作伙伴和赋能工具,而非威胁或主宰。她在空间智能、AI治理、教育等领域的前瞻性探索,为全球AI发展提供了重要的伦理和技术参考。

6.1.1 AI推动创造力与关怀

她强调,AI应成为好奇心与进步的伙伴,推动创造力、关怀和共同目标的实现。AI的发展不应以取代人类为目标,而应助力人类实现更高层次的自我超越。

6.1.2 构建包容、负责任的AI生态

面对AI带来的机遇与挑战,李飞飞呼吁,构建一个包容、负责任、赋能全人类的AI未来。她坚持人类主导、科学治理和社会责任,推动AI技术服务于全社会的共同利益。

总结

李飞飞以其深邃的学术洞见和务实的产业实践,重塑了AI发展的愿景。她反思AGI神话,强调AI与AGI的界限本无本质差异,主张以人为本的AI发展路径。她关注AI的社会影响,倡导科学治理,推动空间智能的突破,并在教育领域探索AI与人类认知的深度融合。她的观点为全球AI发展提供了重要的伦理和技术参考,指引着AI走向更加包容、负责任、赋能全人类的未来。

📢💻 【省心锐评】

李飞飞以科学家之务实与人文主义者之关怀,为狂飙突进的AI注入清醒剂,力主技术向善,回归赋能人类的根本。

.png)

%20%E6%8B%B7%E8%B4%9D-euka.jpg)

评论