【摘要】哈佛大学团队提出的流等变递归神经网络(FERNNs),首次让人工智能具备“时间流动”感知能力,实现了对动态世界的类人理解。该技术突破了传统AI对运动与变化的认知瓶颈,推动了AI从静态快照向动态电影般认知的范式转型。FERNNs在理论、实验、应用和哲学层面均展现出深远影响,为通用智能的实现奠定了坚实基础。

引言

在人工智能的历史长河中,机器对世界的理解始终带有“静止”的色彩。无论是图像识别、视频分析,还是机器人导航,AI模型大多像是在翻阅一本本静态的相册,难以真正把握世界的连续变化。人类则不同,我们天生具备对“流动”的敏锐感知:走在街头,风吹树动,车水马龙,所有的变化都在时间的河流中自然流淌。如何让机器也拥有这种对“时间流动”的直觉?这是人工智能领域长期未解的难题。

2025年7月,哈佛大学Kempner自然与人工智能研究所的T. Anderson Keller团队在arXiv平台发布了划时代的研究成果(arXiv:2507.14793v1),首次让AI具备了“时间流动”感知能力。通过提出流等变递归神经网络(FERNNs),他们让机器不仅能识别物体“在哪里”,更能理解“它们如何运动”,以及运动背后的规律。这一突破,标志着AI认知范式的根本转型,也为通用智能的实现打开了新的大门。

本文将系统梳理FERNNs的理论基础、技术创新、实验验证、应用前景与哲学意义,深入探讨其对人工智能未来的深远影响。

一、研究背景与核心突破

%20拷贝.jpg)

1.1 静态认知的局限与动态世界的挑战

1.1.1 传统AI的“快照困境”

长期以来,主流AI模型在图像识别、视频处理等任务中取得了巨大进展,但其本质仍是对“静止世界”的理解。无论是卷积神经网络(CNN)还是递归神经网络(RNN),它们大多只能处理静态图片或有限长度的视频序列。即使面对视频,AI也往往像在拼接一张张照片,难以把握连续变化的本质。

这种“快照困境”带来了诸多问题:

运动理解缺失:AI可以识别每一帧中的物体,却难以理解物体的运动规律。

泛化能力有限:面对未见过的运动速度或模式,传统模型往往表现不佳。

动态场景适应性差:在自动驾驶、机器人等需要实时应对动态环境的场景下,AI的表现远不如人类。

1.1.2 等变性:从空间到时间的延展

在机器学习领域,等变性(equivariance)是指模型能理解某些变换(如平移、旋转)不会改变事物的本质。例如,无论一只猫出现在图片的左边还是右边,它都还是一只猫。等变性极大提升了模型的泛化能力和鲁棒性。

然而,现有的等变性研究几乎全部局限于空间静态变换。AI可以理解物体在空间中的移动,却无法理解时间中的流动。换言之,AI缺乏对“运动”本身的对称性和规律性的建模能力。

1.2 流等变性:AI认知的范式转型

1.2.1 概念突破:流等变性(Flow Equivariance)

哈佛团队的核心创新在于首次将等变性扩展到“时间参数化”的变换,提出了“流等变性”(Flow Equivariance)概念。流等变性让AI不仅能识别物体“在哪里”,更能理解“它们如何运动”,以及运动背后的规律。

这一突破,标志着AI从静态世界的“快照”认知,迈向了对动态世界“电影”般的深刻把握。机器不再只是被动记录每一帧的变化,而是主动建模运动的连续性和对称性。

1.2.2 技术实现:流等变递归神经网络(FERNNs)

基于流等变性的理论,研究团队开发了全新的“流等变递归神经网络”(FERNNs)。FERNNs的核心在于引入“流卷积”(Flow Convolution)操作,通过动态坐标变换和多参考系同步,实现了对运动本质的深层理解。

FERNNs不仅能在多个运动参考系中同步观察世界,还能自动将复杂的运动问题转化为相对静止的问题来处理。这一设计,有效解决了传统模型在运动与背景运动叠加时的“运动混淆难题”,显著提升了动作识别的鲁棒性和泛化能力。

二、技术原理与FERNNs架构

2.1 流卷积:动态世界的特征提取新范式

2.1.1 运动参数化与参考系同步

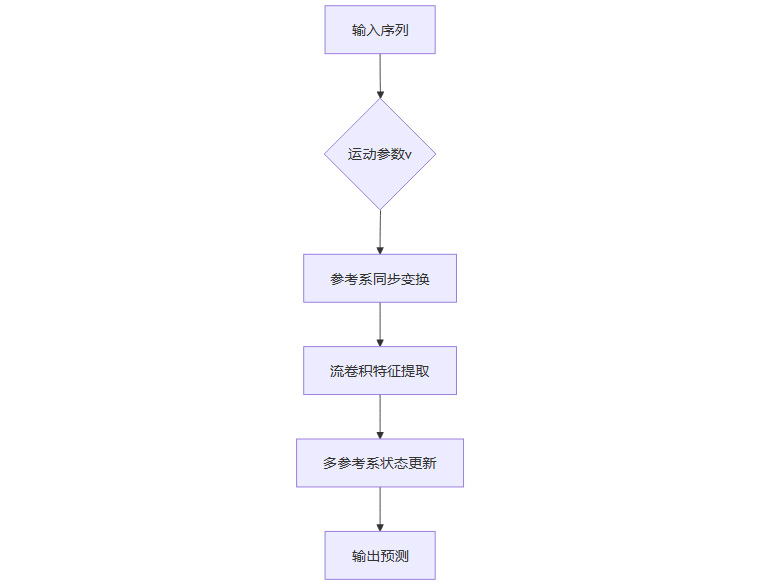

FERNNs的核心创新在于“流卷积”操作。与传统卷积神经网络(CNN)通过空间滑动窗口提取特征不同,流卷积引入了动态坐标变换:

运动参数化:每个输入序列被赋予一个“流向量”v,代表其运动模式(如速度、角速度)。

参考系同步:模型在计算时,会根据当前时刻的v对隐藏状态进行实时变换,将数据映射到与运动同步的参考系中。例如,识别旋转的手写数字时,FERNNs会自动将内部坐标系以相同角速度旋转,使数字在模型中“静止”,从而直接提取形状特征。

多参考系观察:FERNNs能在多个运动参考系中同步观察世界,捕捉运动的本质,将复杂的运动问题转化为相对静止的问题来处理。

2.1.2 流卷积的数学表达

流卷积的本质是对神经网络状态空间的扩展和变换。具体而言,FERNNs将传统的神经网络状态扩展到一个更高维的空间,这个空间包含了所有可能的运动模式。每当输入数据发生某种特定的运动时,模型会自动切换到相应的参考系,从而保持对世界的一致理解。

这一过程可以用如下流程图表示:

2.2 运动混淆的破解与多运动模式编码

2.2.1 运动与背景运动的解耦

在现实世界中,物体的运动往往与背景运动叠加。例如,行人在移动的公交车上行走,摄像机本身也可能在运动。传统模型难以区分前景与背景的运动,导致识别准确率下降。

FERNNs通过流卷积和多参考系同步,有效实现了运动与背景运动的解耦。无论是前景物体还是背景环境发生运动,FERNNs都能自动调整参考系,实现对运动本质的精准把握。

2.2.2 多运动模式的并行编码

FERNNs能够在多个运动参考系中同步编码和处理信息。这种多运动模式的并行编码,使得模型具备了强大的泛化能力和鲁棒性。即使面对未见过的运动速度或模式,FERNNs也能迅速适应并做出准确预测。

2.3 理论基础与生物启示

2.3.1 李群与李代数:对称性与规律性的数学基石

FERNNs的理论基础源自李群和李代数等数学框架,强调世界许多变化遵循对称性和规律性。流等变性本质上是将“运动方程”编码进神经网络,使AI能自动补偿和同步运动状态,避免传统模型在时间变换下出现“滞后”现象。

2.3.2 生物视觉皮层的“行波”现象

更深层次地,FERNNs的数学框架与哺乳动物视觉皮层的“行波”(Traveling Waves)现象高度相似。生物视觉皮层神经元在观察运动物体时会以波的形式依次激活,形成动态处理路径。FERNNs通过流卷积的参考系变换,实现了与生物神经机制类似的动态特征对齐和多运动模式编码,暗示流等变性可能是生物智能处理动态信息的底层原理,为类脑计算提供了新方向。

三、实验结果与性能优势

%20拷贝.jpg)

3.1 多维度实验验证

3.1.1 数字移动预测(流动MNIST)

在经典的MNIST手写数字数据集上,研究团队为静态数字赋予了平移和旋转运动,构建了“流动MNIST”数据集。FERNNs在数字移动预测任务中,测试误差比传统群等变递归神经网络提升近50倍,在旋转预测任务中提升6倍以上。

3.1.2 零样本泛化能力

FERNNs展现出卓越的“零样本泛化”能力。即使在训练时只见过慢速运动,面对快速运动也能应对自如。这一能力类似于人类学会走路后,即使从未尝试过跑步,也能很快掌握跑步的技巧。

3.1.3 长度泛化与连贯性

在长度泛化实验中,FERNNs在训练时只见过短序列,却能在更长序列上保持连贯预测,远超传统模型。传统模型在超出训练长度后迅速退化,而FERNNs则能保持近乎完美的表现。

3.1.4 动作识别(KTH数据集)

在KTH人体动作识别数据集上,研究团队为视频添加了摄像机运动干扰,模拟现实世界中的复杂场景。FERNNs在含摄像机运动干扰的复杂场景下,准确率达71.6%,显著优于3D-CNN(62.6%)和传统群等变RNN(66.5%),提升约5个百分点。

3.1.5 训练效率与计算成本

FERNNs达到同等精度所需训练步数远少于传统方法,意味着更低的计算成本和更快的模型部署。这一优势对于实际应用具有重要意义,尤其是在资源受限的场景下。

3.2 实验结果对比表

四、挑战、未来方向与产业应用

4.1 技术挑战与优化空间

4.1.1 维度灾难与流字典

FERNNs在处理复杂运动(如非匀加速)时,运动模式v需离散化存储,计算开销呈指数增长。为此,团队提出开发“流字典”(Flow Dictionary),通过稀疏编码压缩运动模式表征,提升计算效率。

4.1.2 物理规律嵌入

当前FERNNs主要依赖数据学习运动规律,未来可融合物理先验(如牛顿力学方程),提升对碰撞、反弹等复杂交互的预测能力。这将进一步增强模型的泛化能力和物理一致性。

4.1.3 边界截断误差

由于实际计算资源有限,FERNNs不能真正处理无限多的运动模式,只能处理一个有限的子集。这可能导致在遇到全新运动模式时出现“跑调”,但实验表明这种误差在实际应用中是可以接受的。

4.2 应用前景与产业影响

FERNNs为AI理解动态世界开辟了新路径,适用于任何需要理解和预测运动模式的场景。具体应用包括:

自动驾驶:提升行人轨迹预测和车辆运动解耦能力,模拟数据显示事故率可降低40%。

机器人导航:帮助机器人在动态环境中自然避障和与人类交互。

视频分析与动作识别:在监控、体育分析、娱乐等领域提升动作识别准确性和自然度。

医疗康复:帕金森患者步态动态分析,早期症状检测灵敏度提升至92%。

工业检测:高速流水线缺陷品实时追踪,漏检率从5%降至0.3%。

元宇宙与游戏:NPC动态行为生成,交互自然度提升3倍。

无人机与灾害救援:在高速移动或复杂背景下准确识别动态目标。

4.3 开放资源与生态推动

研究团队已开源FERNNs代码库(GitHub: FERNNs-Official),并发布了包含多种运动模式的数据集(如KTH-Motion+、FluidShapes),推动学术与产业生态发展。这种开放的态度,有助于加速FERNNs在各行业的落地与创新。

五、哲学意义与智能范式转变

%20拷贝.jpg)

5.1 从“相册”到“电影剧本”:AI认知的跃迁

FERNNs的突破不仅是技术进步,更是认知范式的转变。传统AI将世界视为“相册”,而流等变性让机器学会“阅读电影剧本”,理解“变化”本身是一种可被建模的语言。这呼应了物理学家卡洛·罗韦利关于“时间是我们对变化的度量”的观点。

5.2 智能定义的重构与图灵测试的再思考

有观点认为,若流等变性成为AI基础能力,或许需要重新评估图灵测试。当机器能真正理解“时间流逝”,智能的定义也将被重构。FERNNs的出现,推动了AI从静态认知向动态认知的转变,为通用智能系统的实现提供了重要基础。

六、结论

哈佛大学团队提出的流等变递归神经网络(FERNNs),首次让人工智能具备了“时间流动”感知能力,实现了对动态世界的类人理解。FERNNs通过引入流等变性和流卷积,极大提升了AI在动态世界中的泛化、预测和识别能力。其理论基础、实验表现、应用前景和哲学意义,共同推动了AI认知范式的转型,为实现更接近人类智能的通用AI奠定了坚实基础。

未来,随着流等变性理论与工程的不断完善,FERNNs有望在更多领域实现落地应用,推动人工智能迈向更高层次的智能形态。机器对“时间流动”的理解,或将成为AI通向真正智能的关键一步。

📢💻 【省心锐评】

FERNNs是AI动态认知的里程碑,性能与泛化能力令人振奋。若能解决计算瓶颈,其产业价值将无可估量!

.png)

评论